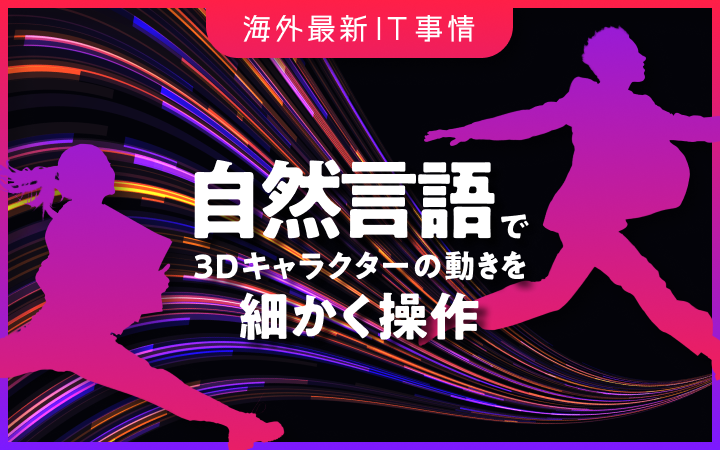

文章で3Dキャラクターの動きを細かく操作できるAI NVIDIAなどが技術開発【研究紹介】

2023年2月13日

先端テクノロジーの研究を論文ベースで記事にするWebメディア「Seamless/シームレス」を運営。最新の研究情報をX(@shiropen2)にて更新中。

NVIDIAなどに所属する研究者らが発表した論文「PADL: Language-Directed Physics-Based Character Control」は、物理的にシミュレートされたキャラクターの動作を、自然言語コマンドを用いてユーザーが指示できる言語指示型アニメーションシステムを提案した研究報告である。

研究背景

複雑でリアルな動作を生み出すことができる物理的にシミュレートされたキャラクターの開発は、コンピュータアニメーションにおける中心的な課題の1つである。この領域における努力は、広範囲のスキルのための高品質のモーションを生成するシステムにつながっている。

しかし、これらのシステムがアプリケーションに有用であるためには、制御モデルは高品質のモーションを生成するだけでなく、キャラクターの行動を指示するためのアクセス可能で多用途なインタフェースをユーザーに提供する必要がある。このインタフェースは、ジョイスティックやターゲットウェイポイントのような制御によって実装されているのが一般的である。ユーザーはこれらの高レベルのコマンドを使用してキャラクターの動作を簡単に操作できるが、ユーザーが積極的に制御できる動作の種類は大幅に制限されているのが現状である。

研究内容

一方で全身モーショントラッキングモデルは、目標とする動きの軌跡を直接指定することで、キャラクターの動きをきめ細かく制御できる汎用的なインタフェースだ。より柔軟な制御が行えるが、動作軌道の作成には、専門的な知識やモーションキャプチャーシステムなどの特殊な機器が必要であり、多大な労力を要する。

理想的なアニメーションシステムは、ユーザーがキャラクターの動作を簡単に指定できるアクセス性の高いインタフェースを提供する一方で、豊富なスキルを制御できる十分な汎用性を備えている必要がある。

自然言語は、ユーザーの意図を簡単に伝えることができる表現力豊かなメディアである。近年の大規模かつ表現力豊かな自然言語処理モデルの開発により、テキスト記述からコードやリアルな画像、動画を生成するなど、幅広い用途に自然言語インタフェースを統合するための強力なツールが提供されている。本研究では、これらの自然言語処理の技術を活用し、入力テキストに応じて物理ベースのキャラクターアニメーションを生成する言語指示型アニメーションシステムを提案する。

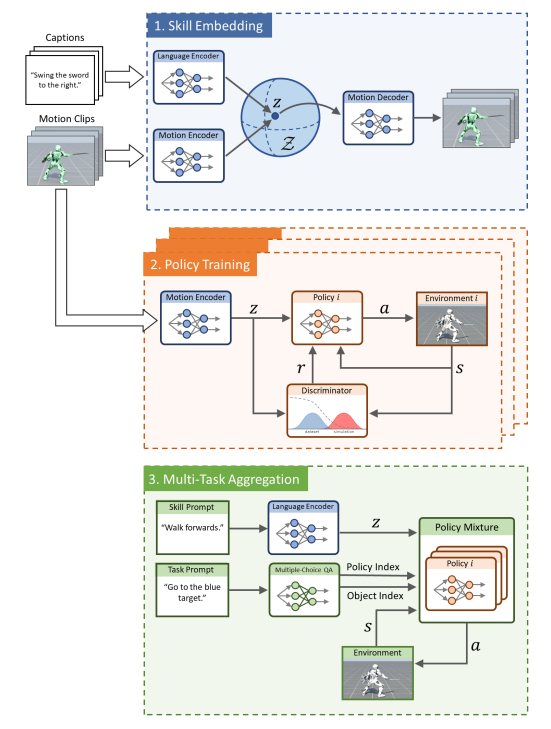

提案システムでは、高レベルの言語コマンドを、ユーザーが指定したタスクやスキルをキャラクターが実行できるような低レベルの制御に対応付けるための制御ポリシーを学習する、敵対的模倣学習を行う。動作クリップと各クリップに映る動作を説明するキャプションのデータセットを与え、キャプションから対応するスキルをキャラクターに再現させる運動コマンドにマッピングする。この学習により、多様なスキルの再現を可能にするとともに、各スキルの言語コマンドの根拠が学習される。

実証実験

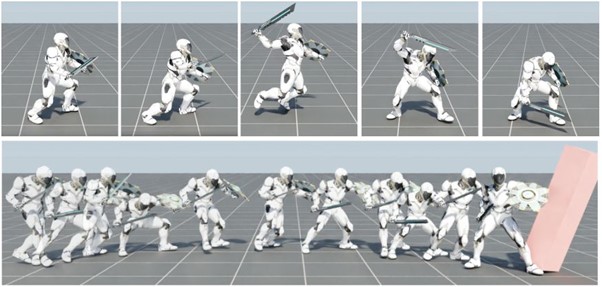

学習されたモデルによって、3Dシミュレーションされたヒューマノイドキャラクターがどの程度制御できるかの有効性を評価する。テストキャラクターには、剣と盾を装備した37自由度を持つヒューマノイドキャラクターを使用する。データセットには合計131個の個別クリップが含まれ、各クリップにはクリップ内のキャラクターの動作を説明する約4個のキャプションが手作業で付けられており、データセット全体で合計265個のキャプションが含まれている。

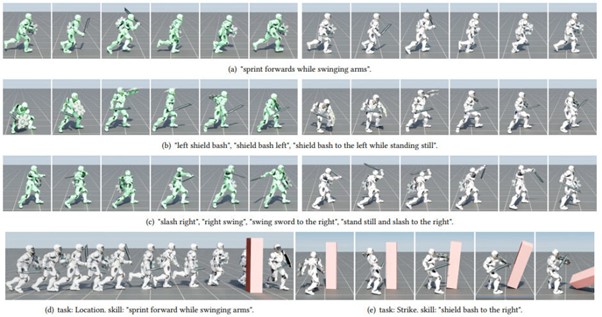

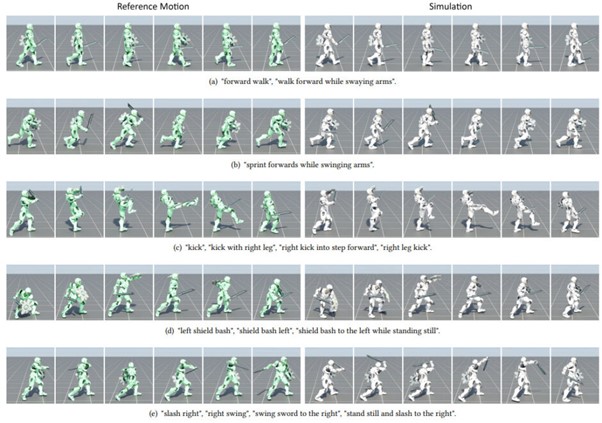

テストの結果、歩行や走行などの運動技能から、剣の振り回しや盾の叩きつけなどの運動技能まで、様々な言語コマンドに対応することが可能であるとわかった。言語エンコーダは大規模なCLIPモデルをベースに構築されているため、データセットにない新しいコマンドに対しても、ある程度の頑健性を示している。

例えば、「take a leisurely stroll」(のんびり歩く)と指示されたとき、データセットに「leisurely」(緩やか)が含まれていなかったり、「taking a walk」(散歩する)と表現しているキャプションがないにも関わらず、キャラクターはゆっくり散歩の動作を行う。これは学習するデータが多ければ多いほど、汎用的な動作が増えることを示唆している。

Source and Image Credits: Juravsky, Jordan, Yunrong Guo, Sanja Fidler and Xue Bin Peng. “PADL: Language-Directed Physics-Based Character Control.” SIGGRAPH Asia 2022 Conference Papers (2022): n. pag.

関連記事

カメラ1台で多人数の全身の動きを3Dモデルで復元する技術 背景の3Dシーンも一緒に再現【研究紹介】

スマホを90度に曲げ、奥行きをリアルに感じながら立体物を編集できる3Dモデリングツール「AngleCAD」【研究紹介】

たった1枚の画像からシャープな3Dモデルを自動生成 Google「3DiM」開発【研究開発】

人気記事