キャラクターの新しい動きを永遠に生成できるモデル「GenMM」テンセント含む研究者らが開発【研究紹介】

2023年7月21日

先端テクノロジーの研究を論文ベースで記事にするWebメディア「Seamless/シームレス」を運営。最新の研究情報をX(@shiropen2)にて更新中。

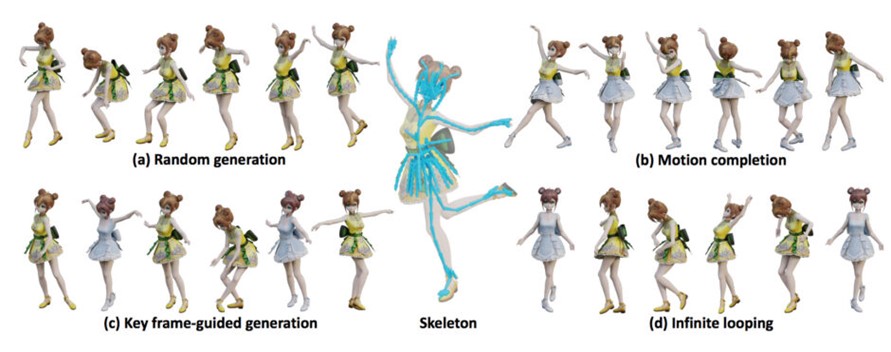

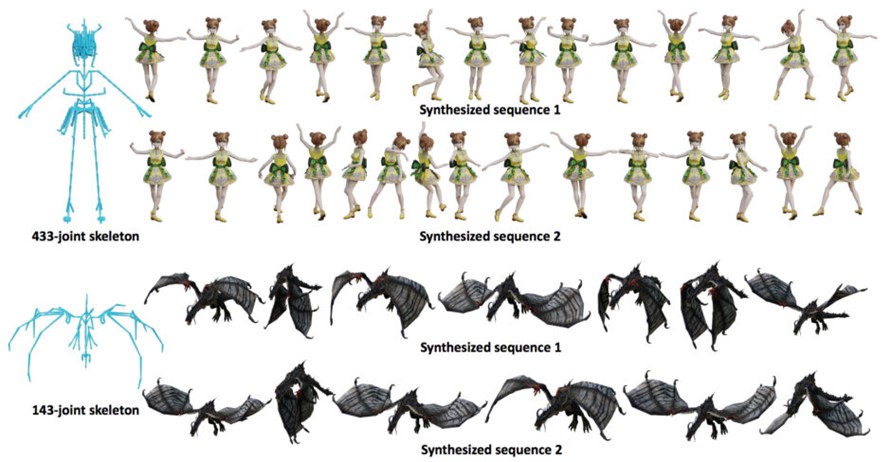

テンセントや中国の大学などに所属する研究者らが発表した論文「Example-based Motion Synthesis via Generative Motion Matching」は、キャラクターの新しいモーションを生成する手法を提案した研究報告である。このフレームワークは「GenMM」と呼び、400以上の関節(衣服など含む)を持つ複雑な動きを要求するキャラクターであっても数秒で多様な新しいバリエーションのモーションを生成する。

研究背景

モーションキャプチャシステムを介して大量のモーションデータを取得したり、高度なアニメーションを手作業でオーサリングしたりすることは、コストがかかり面倒であることが知られている。そのため、モーションデータセットは一般的に限られており、特にスタイル、骨格構造、またはクリーチャータイプの多様性という点で、既存のデータ駆動型モーション合成手法の有効性を妨げている。そのため、限られたサンプルシーケンスから多様で広範なモーションを合成する生成能力を向上させることが重要な研究課題となっている。

深層学習は、大規模かつ包括的なデータセットを使用して学習することで、多様で自然なモーションの合成能力を実証してきた。さらに、訓練に提供されるシーケンスが1つだけであるにも関わらず、ニューラルネットワークはサンプルの内部分布を学習し、入力のサンプルシーケンスの多様な変形を合成する能力も達成してきた。

しかし、深層学習にはいくつかの課題が存在する。例えば、長い学習時間が必要なことや視覚的なアーティファクトが発生しやすいこと、また大規模かつ複雑なスケルトン構造にうまく対応できないことである。

研究内容

本研究では、少数の例から多様なモーションシーケンスを合成するための新しい生成フレームワークを提案する。このフレームワークでは、深層学習が登場する前の技術であるモーションマッチング(Motion Matching)を活用し、先述の課題に取り組む。モーションマッチングは、事前に設定したアニメーションデータを切り貼りする手法であり、自然な見た目のアニメーションを作成できることが特徴である。

システムでは、まず、モーションマッチングのモーションクオリティを保持し、生成能力を注入するために、モーションマッチングの新しいコスト関数として、双方向の視覚的類似性を利用する。双方向類似度は、サンプルと合成されたシーケンスとの間のパッチ分布を比較する目的に役立つ。

具体的には、合成されたシーケンスにはサンプルのシーケンスからのモーションパッチのみが含まれるようにし、逆に、サンプルには合成からのモーションパッチのみが含まれるようにする。その結果、合成にアーティファクトが入ることはなく、重要なモーションパッチが失われることもない。

次に、様々な時間解像度からのパッチ分布を取り込みながら、サンプルとのパッチ分布の不一致が最小になるようなモーションシーケンスを段階的に合成するために、多段階フレームワークを用いる。

既存の研究と比較して、GenMMにはいくつかの利点がある。まず、事前学習なしで非常に高速に動作することである。モーションシーケンスは数秒以内に合成できる。モーションマッチングの魅力的な性質を受け継ぎ、高品質で忠実なモーションを生成する。ニューラルネットワークが苦戦するような非常に複雑な骨格(433個の関節を持つキャラクターなど)に対してもスムーズにスケールする。

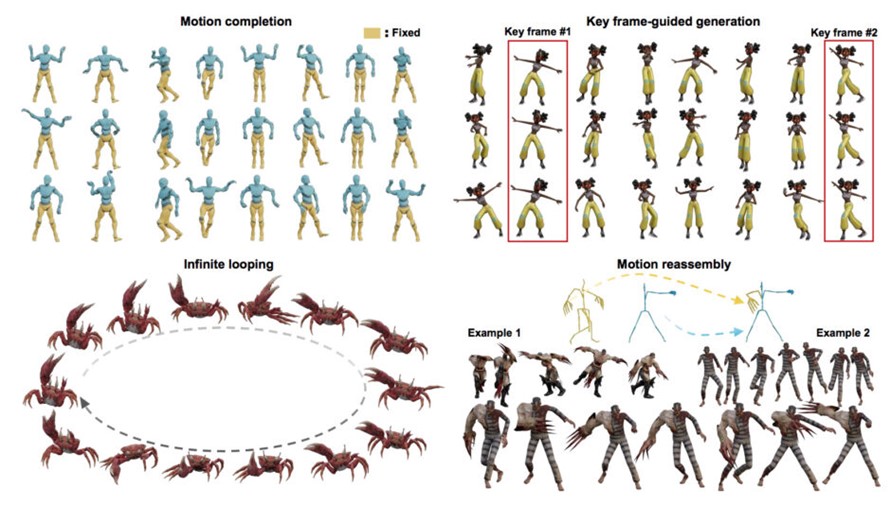

多様なモーション生成に加えて、モーション補完、キーフレーム誘導生成、無限ループ、モーション再組み立てなど、モーションマッチングだけでは達成不可能なシナリオの配列に拡張することで、生成的フレームワークの汎用を可能にする。

Source and Image Credits: Li, Weiyu, Xuelin Chen, Peizhuo Li, Olga Sorkine-Hornung, and Baoquan Chen. “Example-based Motion Synthesis via Generative Motion Matching.” arXiv preprint arXiv:2306.00378 (2023).

関連記事

「顔を少し若返らせて動画配信」 人の若さ具合を自在に変えられる映像編集ツール、Disneyが開発【研究紹介】

Adobeなどの研究者らが開発 「動く落書き」を動画内に溶け込むように描ける編集技術「VideoDoodles」【研究紹介】

画像1枚から永久に続く“空飛ぶシーン”をつくれる技術 Googleなどが開発【研究紹介】

人気記事