最新記事公開時にプッシュ通知します

「ブレーキを踏んだが止まってくれない」自動運転の日常化で浮かび上がるAIと人間の協調の新課題

2024年11月7日

ITジャーナリスト

生活とテクノロジー、ビジネスの関係を考えるITジャーナリスト、中国テックウォッチャー。著書に「Googleの正体」(マイコミ新書)、「任天堂ノスタルジー・横井軍平とその時代」(角川新書)など。

中国では、自動運転機能を備えた乗用車が市販され、無人運転のロボタクシーが営業運転をするようになっている。その最先端で起きたのが「人間とAIの協調」という問題だ。人間とAIの認識の狭間で、自動運転車が原因となる事故や渋滞が相次いでいる。人間はAIとうまくコミュニケーションをとり、共存をしていくことは可能なのか。AI本格導入で見えてきた課題とは。

都市部で普及する自動運転車

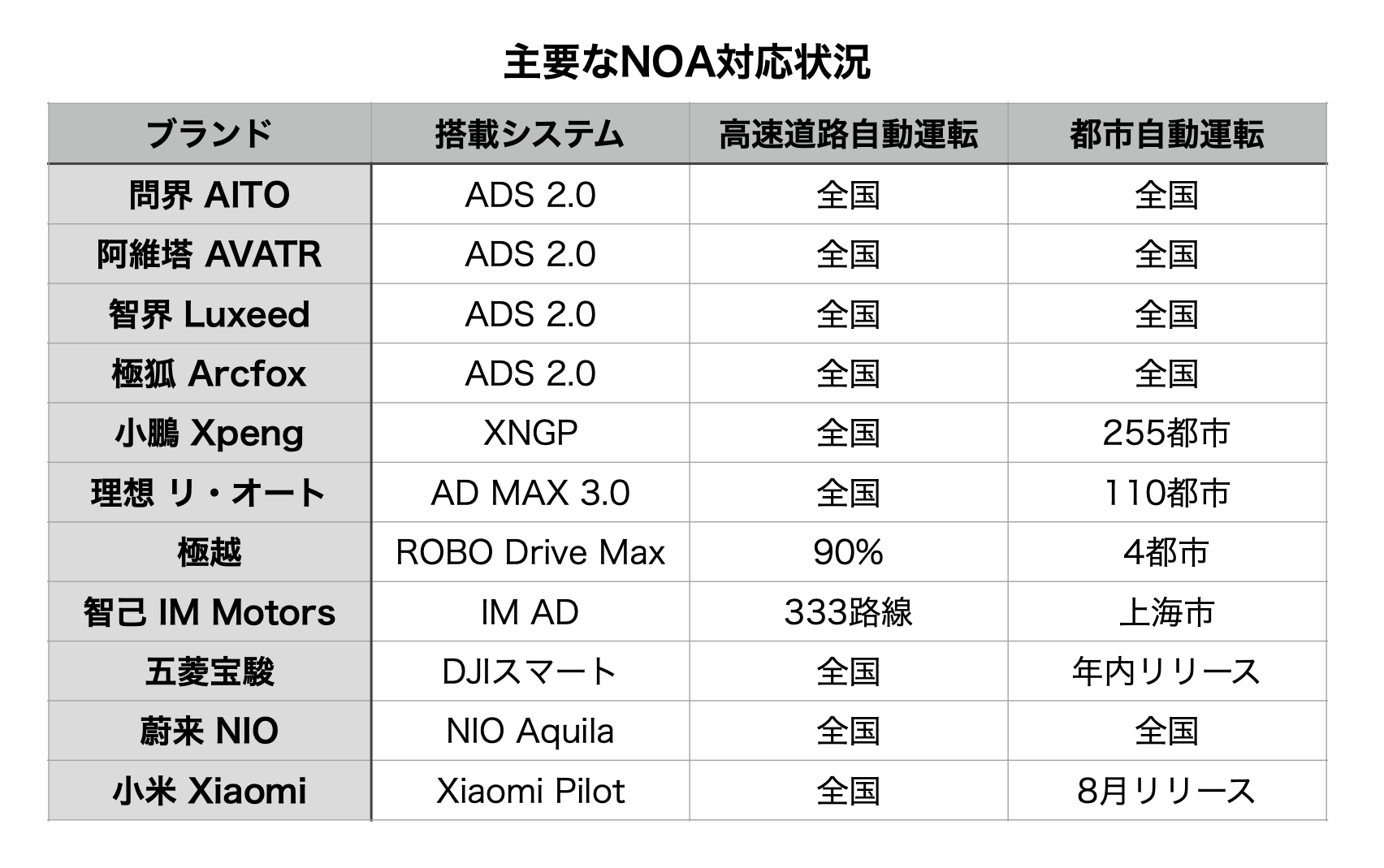

自動運転の領域では中国はすでに先進国になっている。各自動車メーカーは、性能はさまざまだが自動運転システムを販売し、買い切りまたはサブスクリプション契約が選べるようになっている。競争が激しくなるEV(電気自動車)の世界で、車両価格を原価ギリギリに落とし、このようなオプションのソフトウェアやサブスクリプションで利益を生み出すというビジネスモデルも広がっている。

このような自動運転システムの中では、ファーウェイが開発し、自動車メーカーの「賽力斯」(セレス)に提供している自動運転システム(Advance Driving System/ADS)の性能が頭抜けている。テスラのFSD(Full Self Driving)と双璧をなす水準で、テスラのFSDも中国でのサービス提供が決まり、ファーウェイとテスラの性能競争が始まりそうだ。もちろん、このような自動運転機能が搭載されているのは最低でも20万元(約400万円)以上の高価格帯車であり、全体の割合からすればまだまだ少ない。それでも、公道をハンドルから手を離して走行する車が街中を走るようになっている。

では、自動運転の実力はどの程度だろうか。中国の自動車メディア「AutoLab」は公式のSNSで、問界M7、蔚来ES8、小鵬G6、理想L9の4車種が走行するテスト映像を公開した。テストでは、中国の地方都市宜興市で108.0km(信号103ヵ所)と大都市の上海市で180.7km(信号286ヵ所)の同ルートを同時刻に走行した。

AutoLabのテストでは、いずれもファーウェイのADSを搭載した問界M7が最も成績がよかった。地方都市では100%の自動運転が可能だったが、人間が16回能動的に運転介入をした。運転介入は平均して6.75kmに1回起きたことになる。大都市では99.56%の距離を自動運転で走行した。システムが運転介入を求めたことが4回あり、人間が26回能動的に運転介入をした。平均して6.92kmに1回になる。

つまり、現状の自動運転は「ほぼほぼ自動車任せにできるが、7km弱に1回程度、人間が手伝ってやらなければならない」状況だ。それであっても、人間がしなければならない操作はほとんどなくなり、運転の負担は大きく減ることになる。

自動運転システム「レベル2+」

このような自動運転システムは、俗に「レベル2.9」「レベル2+」などと言われている。運転主体はあくまで人間側にある。自動運転中でも運転者は周囲の環境を監視し、危険を感じたら、運転に介入して適切な回避行動をとらなければならない。事故が起きた場合は、自動運転中であっても、メーカーに重大な過失がなければ、「危険を察知して適切な運転介入をしなかった運転者」の責任が問われることになる。そのため、自動運転中であっても、スマホを注視したり、居眠りをすることはできない。30秒から2分に1回はハンドルにタッチしないと、自動運転は解除される仕組みになっている。それでもハンドルに触らないと、自動車は安全停止をする。

自動運転中の人間による運転介入には、受動的なものと能動的なものの2種類がある。自動運転中、AIが安全な走行ルートが確保できないと判断した時は、警告音を鳴らしてAIが運転介入を求めてくる。例えば、臨時の車線規制が行われ、警官が誘導している場合、AIは警官の手信号が理解できず、反対車線を一時的に走行する判断をできず進めなくなる場合は人間に運転介入を求めてくる。また、雨や霧などでLiDAR(光による検知と測距)などのセンサー類の精度が落ちている場合も、人間に運転介入を求めてくることがある。

一方、AIに任せてもいいが、周囲の迷惑になるため人間が運転介入をすることがある。例えば、1車線しかない道路で前の車が停車をし、荷下ろしを始めた。人間であれば、対向車がこないことを確認して反対車線を使って追い越すところだが、AIは、反対車線を走行することは交通規則違反になるため、辛抱強く前の車が動くのを待ってしまう。それでは後続の車に迷惑になるため、人間が操作をして前方の車を避けて前進する。ハンドルやペダルを操作すれば、自動的に自動運転は解除されるようになっている。

自動運転の日常化で見えた人間本能とAIの衝突

この自動運転に対する評価は人により大きく違う。新しいテクノロジーが好きな人は絶賛をするが、「AIの運転は信用できない。人間の方が信頼できる」と主張する人も少なくない。

自動運転で先行をしているテスラのFSDでは、「Impact Report 2023」によると、2023年の自動運転中の事故率は100万マイルあたり1.49件と報告されており、これは平均的な米国の事故率の1/7に相当するという。ただし、この数値は自動運転に任せっきりで取れた結果ではない。前述の通り、現在の自動運転は運転者が主体となるもので、自分の意思でオン、オフすることができる。一般的な運転者はまっすぐ走ればいい単純で退屈な局面ではFSDをオンにするが、交通状況が複雑な状況ではオフにして手動運転に切り替える傾向があるからだ。事故が起きやすい状況では自動運転が解除される傾向があると考えられ、事故率の数値は低めになっている可能性がある。

中国でも自動運転機能搭載の車の事故はたびたび注目される。事故が起きるたびに「自動運転システムが事故を起こした可能性」が報道され、その度にアンチAI派は勢いづくが、結局、「手動運転中でした」というオチがつくということが繰り返されている。

しかし、今年2024年3月に広東省の高速道路で起きた事故は、肯定派、否定派ともに考えさせられる事故となり、議論を呼んだ。

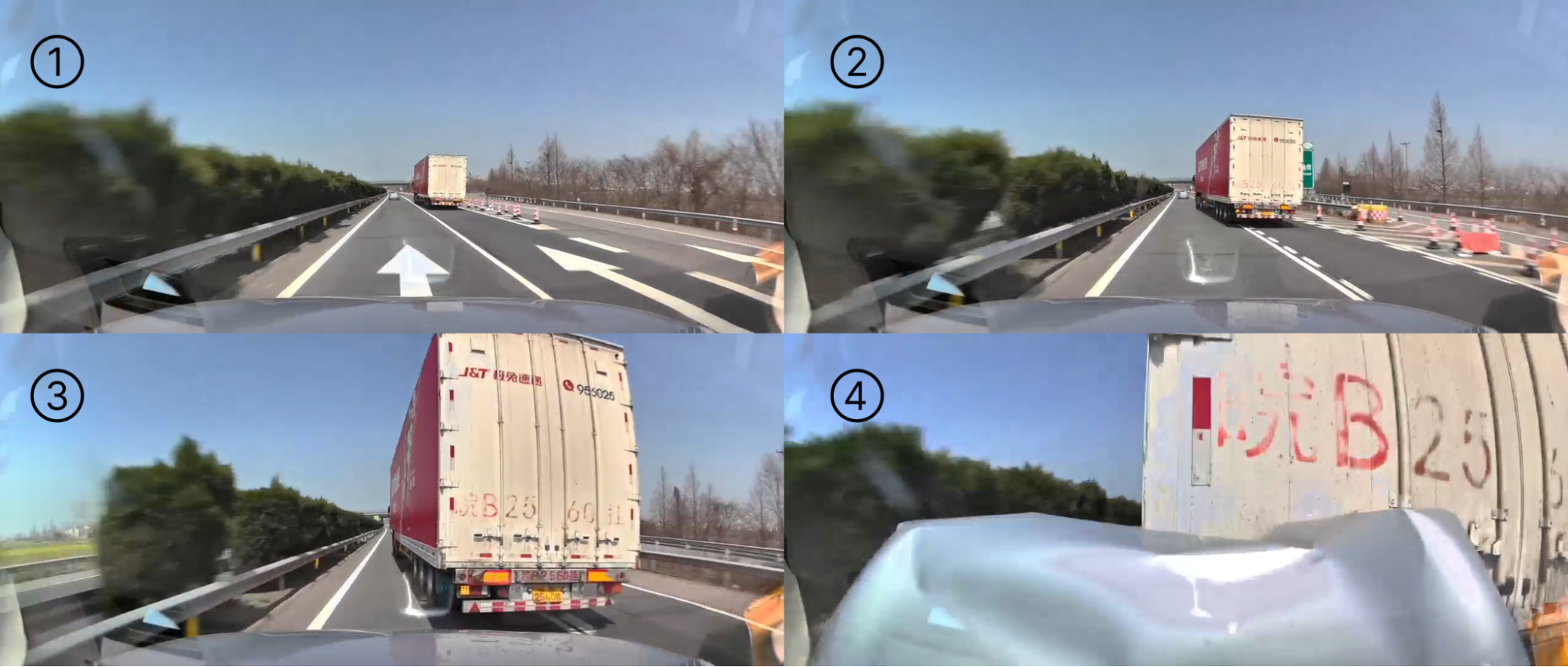

M7を運転していた女性は、広東省の高速道路を自動運転で走行中だった。追い越し車線(中国は右側通行なので左車線が追い越し車線になる)を順調に走行し、右車線にいる低速のトラックを追い抜く時にその事故は起きた。トラックは後方確認をせずに追越車線に車線変更をして、M7の前に出てきた。そのままトラックの後尾に追突をしてしまった。女性が公開した映像によると、パニックになった女性が何度も「なぜブレーキが効かないの」と叫んでいる。女性は自動運転中であったのになぜ追突したのかとSNSで訴えたが、メーカーの解析により、事情はそう単純でないことが判明した。

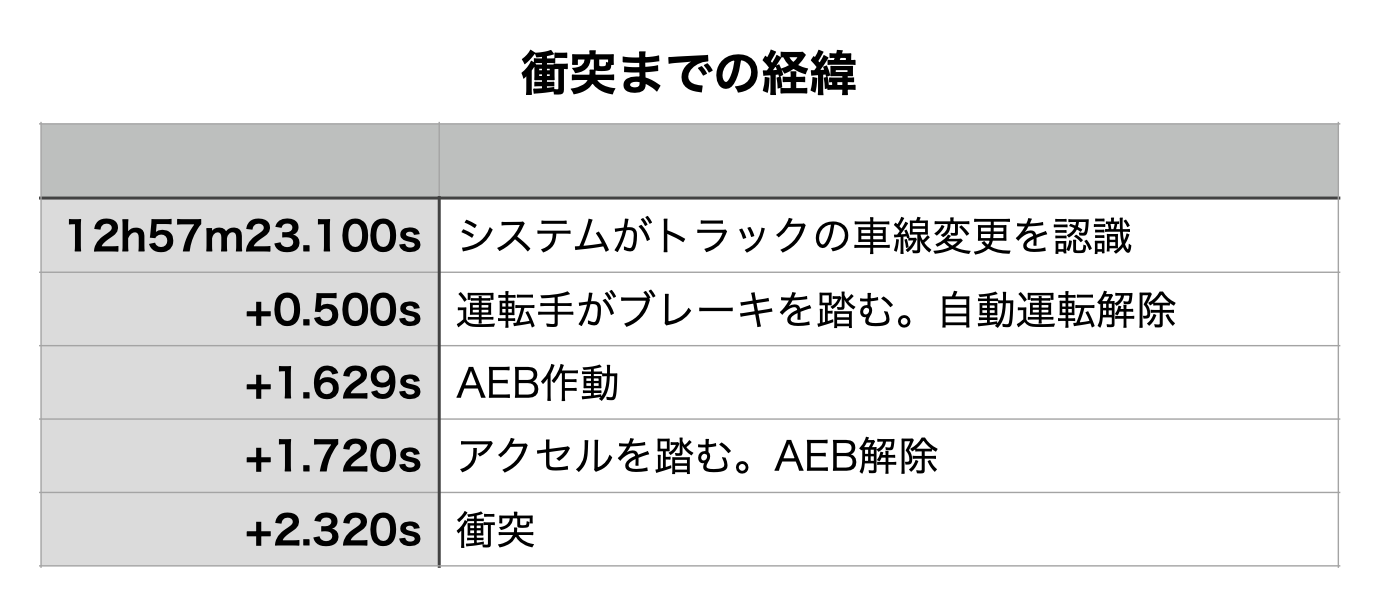

女性がM7のメーカー「セレス」との交渉の中で興味深い事実が明らかになった。セレス側がEDR(Event Data Recorder)を解析すると、トラックの車線変更をシステムが認識をした0.5秒後に女性がブレーキを踏んだため、自動運転が解除されたということが判明をした。ハンドルやペダルを操作すると、自動運転は自動的に解除されて手動運転に切り替わる仕組みになっている。

手動運転に切り替えてもブレーキを踏んでいる限り、AEB(衝突衝撃軽減ブレーキ)が作動し、衝突は避けられるか衝撃が軽減されるはずだ。しかし、AEBが作動した0.091秒後に女性はなぜかアクセルに踏み直しているのだ。つまり、自動運転中であったものの、女性がブレーキを踏むことにより手動運転に切り替わり、女性の運転操作ミスで衝突が起きたということになる。女性は関係者に謝罪をして、アカウントを削除した

議論になっているのは、AIによる自動運転と人間の協調の問題だ。あの状況で、ブレーキを踏んでしまうのは人間として自然な行動だ。アクセルを踏み直しているのが不可解だが、ブレーキを踏むことにより期待される挙動と、AEBによる挙動にずれを感じ、とっさの判断でペダルを踏み間違えているのではと考えたとしても責められない。結論からいうと、女性は何もせずに、システムに任せることが正解だった。衝突は避けられなかったかもしれないが、考えられる限り最小の衝撃で済んだはずだ。しかし、AIと人間が運転でどう協調し、どう運転主体の受け渡しをするのか、明快な解決策は誰も持っておらず、このAIと人間の不協和により事故が起きる可能性が残されている。

完全無人運転のロボタクシーにも課題が

一方、運転手のいない完全無人運転のロボタクシーもすでに10以上の都市で営業運転を始めている。その中でも規模が大きいのが、百度(バイドゥ)の「蘿卜快跑」で、今年3月に湖南省武漢市に一気に数百台を投入し、24時間の正式営業を始めた。年末までには1000台規模の投入を計画しており、現在12都市でサービスを展開している。「蘿卜」は大根のことだが、読み方が「ロボ」の音訳になっている。

ロボタクシーは完全無人運転だが、安全な走行ルートが確保できないと判断した時は安全停止をする。そして、センターにいる監視員がリモート運転をして、自動運転ができる状態に復帰させるのだ。現在は法令により、1人の監視員が担当できるのは3台までに限定されているが、百度の関係者によると20台程度まで担当しても安全性は十分に確保できるという。

その矢先の2024年7月7日に、ロボタクシーは歩行者との接触事故を起こした。ロボタクシーが青信号で交差点を進行中、赤信号を無視して横断した歩行者が接触したもので、ケガの程度は軽微だという。ロボタクシーは他の車の接近や歩行者を認識すると、まずは安全停止をするという保守的な戦略を採用しているため、事故が起きる可能性は極めて低く、起きても軽微な接触事故がほとんどで、安全性は確保されているという。

しかし、大量導入された武漢市では、事故よりもロボタクシーにより引き起こされる渋滞が問題になっているという。

武漢市では、市政に関する苦情、相談などを受け付ける「武漢城市留言板」を運営している。市民であれば書き込みをすることができ、そのすべてに対して担当者が返答し、そのやりとりは匿名処理をした上で公開され、誰でも読むことができる。この伝言板にロボタクシーに対する苦情が300件以上も寄せられた。

「開発区全力南片区では、毎朝のラッシュ時、ロボタクシーが異常な交通渋滞を引き起こしています。道路の真ん中に意味なく停車をするからです。普通なら5分で行けるはずのところが20分以上かかります。朝夕のラッシュ時はロボタクシーの運行を禁止すべきだと思います」。

なぜ、ロボタクシーは「意味なく停車する」のか。それは交通規則を厳格に守るからだ。交通規則では6mの車間距離を空けることになっているため、ロボタクシーはそれに従う。しかし、現実にはそれだけの車間を空けていると、バイクや車が割り込んできてしまう。ロボタクシーは、そこからさらに6mの車間距離を確保しようとするため前に進めなくなる。

十字路で他車と出会い頭になった場合もロボタクシーの基本戦略は「譲る」だ。そのため、人間の運転する車が次々にこれ幸いと十字路に侵入してきて、ロボタクシーはなかなか進めず、後続の車は迷惑をすることになる。

面白いのは、正しい運転をしているのはロボタクシーの方だということだ。実際の市街地では、交通法規に厳格に従うと進めなくなってしまったり、後続の車に迷惑をかけることがある。人間は、人間同士融通を利かせ、小さな交通違反をしながら、互いに迷惑にならないようにうまくやっている。AIには、この融通を効かせるということができない。

AIが人間特有の小さな交通違反をする融通さを学ぶか、それとも人間が悔い改めて交通規則に厳格に従うか、いずれかにしないとロボタクシーは渋滞の原因となり続けることになる。人類はこれから数十年間、さまざまな経験をしながら、AIとうまくやっていく方法を学ばなければならなくなっている。これからの社会人は、人とだけでなく、AIとのコミュニケーション能力も求められるようになるかもしれない。

関連記事

自動運転はもはや未来の技術ではない。テスラ、HUAWEI、バイドゥにみる「レベル2+」の自動運転車の課題

材料を「空中に浮かせながら」工作するロボット、部品や接着剤の液を音で浮遊させ、接触なしで組み立て可能【研究紹介】

【石黒浩教授】ロボット研究の副次的存在だった「アバター」で、いま未来を変えたい理由【Developer eXperience Day 2024 レポート】

人気記事