不正競争防止法と個人情報保護法の観点で解説する、生成AIに関する情報管理・漏洩の法的問題

2023年11月6日

モノリス法律事務所 代表弁護士

元ITエンジニア。IT企業経営の経験を経て、東証プライム上場企業からシードステージのベンチャーまで、100社以上の顧問弁護士、監査役等を務め、IT・ベンチャー・インターネット・YouTube法務などを中心に手がける。主な著書に「ChatGPTの法律」(共著 中央経済社)・「ITエンジニアのやさしい法律Q&A」(技術評論社)・「IT弁護士さん、YouTubeの法律と規約について教えてください」(祥伝社)などがある。まんがタイムきららフォワード(芳文社)にて原作を手がける「仮想世界のテミス」連載中。

X(@tokikawase)

生成AIを商用利用する場合、企業秘密や個人情報の取扱いには特に注意する必要があります。なぜなら、生成AIに入力された情報は、機械学習に利用されてしまう場合があるためです。企業秘密や個人情報が機械学習に利用されるということは、同じ生成AIを利用している第三者の出力画面に、それらの情報がそのまま表示されてしまうおそれがあるということです。

そのため、何ら対策もせず事業活動において生成AIを利用すれば、情報管理が不十分という他なく、容易に情報漏洩の問題を引き起こしかねません。

そこで本記事では、生成AIを利用する際に留意すべき情報管理・漏洩に関する法的問題について、特に不正競争防止法と個人情報保護法の観点から解説します。

不正競争防止法上の問題点:「営業秘密」性の喪失

生成AIに顧客名簿や技術情報等を入力してしまうと、その情報が「営業秘密」としての法的保護を受けないようになってしまう危険性があります。

なぜこうした問題が起こり得るのか、順に解説します。

まず前提として、「営業秘密」を保護する法律は、不正競争防止法です。同法は、企業が事業活動における努力の成果として獲得した一定の情報を「営業秘密」として特別に保護しています。営業秘密には、顧客名簿などの営業上の情報だけでなく、ソースコードのような技術上の情報も含まれており、特に競争上高い価値を有する技術上の情報は、模倣されてしまうと企業の存続にまで影響を及ぼすことがあるため、秘密にしておく必要性が高いものといえます。

しかし、事業活動に多くの人間が関わる企業においては、このような情報を秘密として保護することは容易ではありません。そのため、従業員の転職やフリーランスへの外注等に伴う情報漏洩はしばしば問題となります。

そこで、不正競争防止法では、「営業秘密」に該当する情報を不正に取得・使用・開示する行為を不正競争行為として禁止しており、また、不正競争行為に対する差止請求や損害賠償請求を認めています。

「営業秘密」とは

「営業秘密」として保護されるためには、次の要件をすべて満たしている必要があります。

- 1 秘密管理性(「秘密として管理されている」こと)

- 2 有用性(「事業活動に有用な技術上又は営業上の情報」であること)

- 3 非公知性(「公然と知られていない」こと)

以下では、各要件について、少し詳しく解説します。

・秘密管理性

一般に、秘密管理性が認められるためには、情報の保有者において、当該情報が秘密であると単に主観的に認識しているだけでは足りません。秘密として管理しようとする意思(秘密管理意思)が、合理的な秘密管理措置によって従業員等にも容易に認識できる状態 で管理されている必要があります。

典型的には、「機密」や「社外秘」、「公開禁止」などの記載があり、かつ、会社の金庫などで厳重に保管されている書類がこれに当たります。データであれば、アクセスできる者が制限され、もしくは社内規則に守秘義務が明示されている情報であれば、基本的には秘密管理性が認められるでしょう。

もっとも、管理方法には画一的な基準があるわけではなく、当該情報の性質や保有形態、企業の規模等に応じて要求される情報管理の程度や状態は異なります。また、当該情報を利用する者が、企業内部の従業員なのか外部の者なのかによっても異なります。

・有用性

有用性に明確な定義はありませんが、不正競争防止法では「生産方法」と「販売方法」が有用な情報として例示されています。生産方法とは、製品の設計図や製法、製造上のノウハウなどのことです。もう一方の販売方法とは、顧客名簿や販売マニュアル、仕入れリストなどのことです。

事業活動に現に用いられている情報でなくても、将来又は潜在的に役に立つ情報あれば有用性は否定されません。例えば、失敗した実験データのように、実際には事業活動に利用されない情報であっても、有用性が認められる可能性があります。

・非公知性

非公知とは、当該情報が刊行物に記載されていないなど、保有者の管理下以外では一般的には入手できない状態を意味します。ただし、保有者以外にも多くの者が当該情報を知っていたとしても、守秘義務が課されていれば、保有者の管理下にあるものといえ、非公知といえます。逆に、たった1人でも保有者の管理下にない部外者に知られてしまった場合には、当該情報は公知となります。

では、製品の外観上は当該情報を認識できなくても、リバースエンジニアリングによれば認識できる情報に非公知性は認められるでしょうか。

この点、リバースエンジニアリングが容易な場合には、製品を市場に流した時点で非公知性は失われるものと考えられています。他方で、リバースエンジニアリングに多大な労力やコストを要する場合には、製品を市場に流しても非公知性は失われません。この場合には、依然として競争優位性があり、保護に値するためです。

生成AIに機密情報を入力してしまうと「営業秘密」として保護されなくなるのか

前述のとおり、生成AIに入力された情報は機械学習に利用される場合があります。機械学習に利用された情報は、他人が入力したプロンプトに対するアウトプットとして出力される可能性があります。

仮に従業員等が生成AIに機密情報を入力してしまった場合、当該機密情報は「営業秘密」して保護されなくなってしまう恐れがあります。なぜなら、従業員等が生成AIに自社の機密情報を自由に入力できてしまうとなると、営業秘密として保護されるために必要な秘密管理性の要件を満たさないといえてしまうためです。

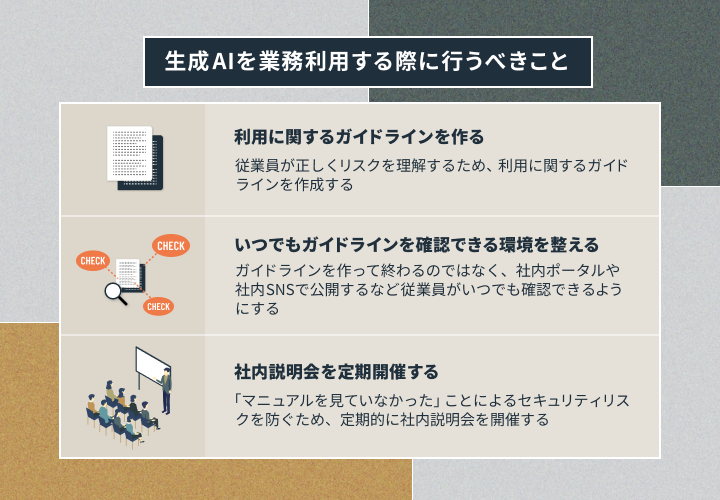

そのため、企業として生成AIを業務に利用する場合には、生成AIの利用に関するガイドライン等を整備し、従業員等への周知を徹底する必要があるでしょう。

なお、機密情報が営業秘密に該当しないとしても、秘密保持契約を締結している場合には、契約内容を遵守する必要があります。生成AIの利用に関して明記されていない場合には、「どのような情報を」「そのような範囲で」利用可能なのか、慎重に確認する必要があるでしょう。

個人情報保護法上の問題点

顧客情報等の個人情報を生成AIに扱わせると、生成AIという「第三者」に対して個人情報を渡したものとして、個人情報保護法違反になってしまうリスクがあります。また、後述するように、特に医療関連のビジネスにおいては、生成AIの学習データとして個人情報を用いることに関しても、細かい検討が必要です。

生成AIに関する個人情報保護法上の問題を考える際は、次の3つの段階を分けて考えることが有用です。

- 1 生成AIの開発・学習段階

- 2 プロンプトの入力段階

- 3 生成物の利用段階

また、個人情報保護法上の規律としては、情報の「取得・利用場面」と「提供場面」に関する規律が特に問題となります。これらの場面を念頭に、上記各段階において、どのような規制が及びうるのかという観点から解説します。

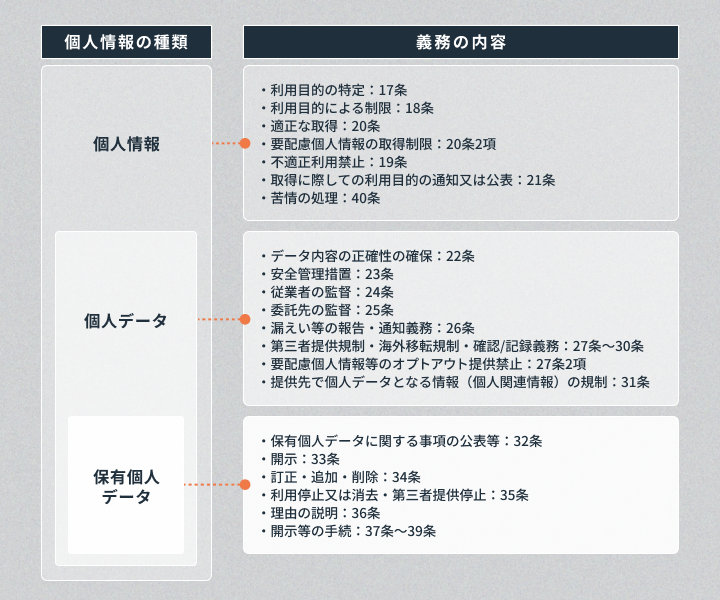

個人情報保護法の全体像

個人情報保護法では、取り扱う個人情報の種類に応じて、課される義務が異なります。表にまとめると、以下のとおりです。

「個人情報」とは、生存する個人に関する情報のうち、特定の個人を識別できるものを意味します。「個人データ」とは、個人情報データベース等を構成する情報のことです。例えば、1枚1枚の名刺に記載された偏在する情報は「個人情報」ですが、Excel等の表計算ソフト等で整理された情報は「個人データ」に当たります。

重要なのは、上記表のとおり「個人情報」であっても「個人データ」に該当しない限り、個人データに関する規制は適用されない、ということです。

このことを前提に、以下では「個人情報の取得・利用場面」と「個人データの提供場面」を区別して、各場面における生成AIに関する個人情報保護法上の問題点を解説します。

個人情報保護法上の問題点:個人情報の取得・利用場面

個人情報を取得する場合、その利用目的をできるだけ特定(法17条)するとともに、プライバシーポリシー等で公表・通知(法21条)することが義務づけられています。

また、個人情報を利用する場合には、本人の同意なく、特定された利用目的の達成に必要な範囲を超えて個人情報を取り扱うことが禁止(法18条1項)されています。

なお、個人情報を取得する場合、本人の事前同意は、原則として不要であり、例外的に、要配慮個人情報を取得する場合に必要(法20条2項)となります。

「要配慮個人情報」とは、個人情報保護法が規定する、「個人情報」の中でも特に慎重な取扱が求められる情報です。例えば、住所や氏名といった一般的なものは、「個人情報」ではあっても「要配慮個人情報」ではありませんが、人種や信条、前科・前歴などの情報は「要配慮個人情報」と扱われます。ビジネスで扱われやすいものとしては、レセプト等に記載された情報を含む病歴も、「要配慮個人情報」です。

生成AIとの関係では、この要配慮個人情報の取得に特に注意しなければなりません。例えば、AI開発の過程では機械学習のため、社内データベースやWeb上の膨大な情報を取得することになります。その中には、意図せずとも要配慮個人情報が含まれてしまうことがあります。また、ユーザー自身がプロンプトに自分の要配慮個人情報を入力する場合であっても、必ずしも機械学習に利用されることを容認しているとは限りません。

このような観点から、個人情報保護員会は、2023年6月12日に「生成AIサービスの利用に関する注意喚起等について」(以下「注意喚起」といいます)を公表しています。注意喚起別添2では、要配慮個人情報を取得する場合に以下の事項を遵守すべきことが求められています。

- (1)機械学習のために情報を収集することに関して、以下の4点を実施すること。

- (1) 収集する情報に要配慮個人情報が含まれないよう必要な取組を行うこと。

- (2) 情報の収集後できる限り即時に、収集した情報に含まれ得る要配慮個人情報をできる限り減少させるための措置を講ずること。

- (3) 上記1及び2の措置を講じてもなお収集した情報に要配慮個人情報が含まれていることが発覚した場合には、できる限り即時に、かつ、学習用データセットに加工する前に、当該要配慮個人情報を削除する又は特定の個人を識別できないようにするための措置を講ずること。

- (4) 本人又は個人情報保護委員会等が、特定のサイト又は第三者から要配慮個人情報を収集しないよう要請又は指示した場合には、拒否する正当な理由がない限り、当該要請又は指示に従うこと。

- (2)利用者が機械学習に利用されないことを選択してプロンプトに入力した要配慮個人情報について、正当な理由がない限り、取り扱わないこと。

個人情報保護法上の問題点:個人データの提供場面

個人データを第三者に提供する場合には、原則として、あらかじめ本人同意を得ることが必要(法27条1項)とされています(以下「第三者提供規制」といいます)。もっとも、例外的に「委託」に伴い個人データを提供する場合には、当該委託先は「第三者」に該当しないこととされているため、事前の本人同意は不要(法27条5項1号)となります。

また、外国にある第三者に対して個人データを提供する場合には、さらに加重された義務を負う(28条)ことになりますが、この場合には、委託に伴う提供等の例外規定は適用されません。

・プロンプトに個人データを入力する行為が「提供」に該当するか

生成AIとの関係では、ユーザーがプロンプトに個人データを入力した場合に、ユーザーからAI事業者に対する「提供」に該当するか否かが問題となります。

「提供」とは、個人データを自己以外の者が利用可能な状態に置くこと意味します。例えばクラウドサービスにおいては、「クラウドサービス提供事業者が、当該個人データを取り扱わないこととなっている場合」、典型的には契約条項によって当該外部事業者がサーバに保存された個人データを取り扱わない旨が定められています。適切にアクセス制御を行っている場合など、「提供」に該当しないものとされています(一般的に「クラウド例外」と呼ばれる解釈です)。

上記のクラウド例外が生成AIにも当てはまるとすれば、ユーザーが入力するプロンプトに個人データが含まれていたとしても、「提供」に該当しないことから、第三者提供規制は適用されません。ただし、この点に関しては、生成AIごとに個別具体的に検討する必要があります。すべての生成AIにおいて一概に上記のような入力行為が「提供」に該当しないというわけではありません。

例えば、ChatGPTではAPI以外を経由して受信したコンテンツ(非APIコンテンツ)についてはサービス開発改善のために利用する(別途オプトアウトの申請は可能である)旨が定められています。そうすると、ChatGPT APIを利用して独自のサービスやコンテンツを開発する場合には、上記の入力行為は「提供」には該当しないものの、エンドユーザーとしてChatGPTを利用する場合には(オプトアウトの申請をしない限り基本的には)上記入力行為は「提供」に該当することになると考えられます。

ただし、「不正使用や悪用を監視する目的」に限っては、OpenAI社が個人データにアクセスする可能性がある旨が留保されている点に鑑みると、APIコンテンツであるか否か、また、オプトアウトの申請をするか否かにかかわらず、「提供」に該当すると解する余地もあります。

・「委託」の例外が適用されるか

前述のとおり、「委託」に伴い個人データを提供する場合には、例外的に第三者提供規制は適用されません。そこで、仮にプロンプトに個人データを入力する行為が「提供」に該当するとしても、かかる例外が適用されるか否かも検討する必要があります。

「委託」とは、契約の形態・種類を問わず、事業者が他の者に個人データを取扱わせることです。ただし、委託元が委託先を監督することが前提とされている(法25条)点に鑑みると、ユーザーがAI事業者を監督することはあまり現実的ではないことから、上記入力行為を「委託」と構成することは困難であると思われます。

したがって、基本的にはプロンプトに個人データを入力する行為には第三者提供規制が及ぶと解したうえで、従業員等がプロンプトに個人データを入力しないようにするセキュリティ体制を構築しておくことが重要です。

関連記事

ChatGPT商用利用時、規約上の注意点3つ|元ITエンジニアの弁護士が徹底解説

【新連載】生成AIで書くソースコードの著作権をどう考えるべきか?元ITエンジニアの弁護士が徹底解説

「開発者体験がいい=エンジニアが働きやすい」だけではない。藤倉成太が語る、今こそ本気で開発者体験と向き合うべき理由【日本CTO協会特別企画】

人気記事