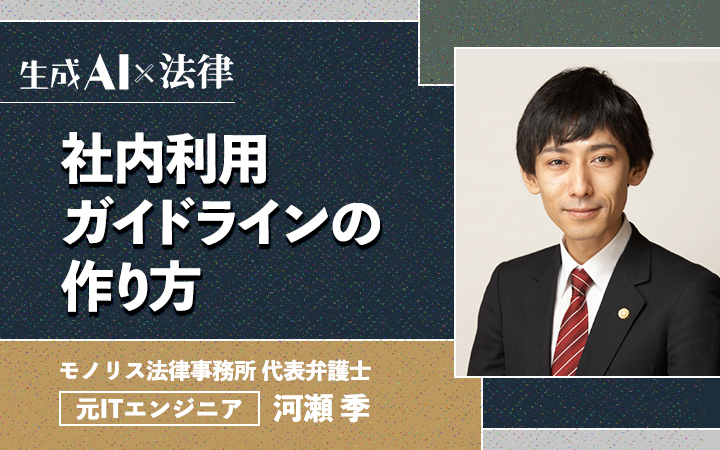

ChatGPT商用利用時、規約上の注意点3つ|元ITエンジニアの弁護士が徹底解説

2023年9月28日

モノリス法律事務所 代表弁護士

元ITエンジニア。IT企業経営の経験を経て、東証プライム上場企業からシードステージのベンチャーまで、100社以上の顧問弁護士、監査役等を務め、IT・ベンチャー・インターネット・YouTube法務などを中心に手がける。主な著書に「ChatGPTの法律」(共著 中央経済社)・「ITエンジニアのやさしい法律Q&A」(技術評論社)・「IT弁護士さん、YouTubeの法律と規約について教えてください」(祥伝社)などがある。まんがタイムきららフォワード(芳文社)にて原作を手がける「仮想世界のテミス」連載中。

X(@tokikawase)

例えば、ChatGPTの生成する回答は、情報が不正確である危険性があり、これを利用したサービスを公開等する場合、AI生成物であることを明示する必要があります。また、ChatGPT APIを利用したコンテンツに「○○GPT」といった名称を付与することができないなど、規約上で定められている禁止事項もあります。このように、生成AIを利用するにあたっては、まずこのレベルのルールを把握しておくことも重要です。

今回は、昨今最も多くの人が利用している生成AIのひとつであろうChatGPTを例に、ChatGPTを商用利用する場合と、それに伴う規約上の注意点について解説します。

ChatGPTの特徴

まずは前提として、ChatGPTの特徴を簡単に解説します。

ChatGPTは、人間がプロンプト(指示/命令文)を入力すると、事前に学習したデータをもとに、それに対する適切な回答を会話形式で自動生成してくれる生成AIを利用したサービスであり、アメリカのOpenAI社が提供しています。

生成AIは、従来のAIが学習データから適切な情報を「抽出」しているだけであるのに対して、ChatGPTは学習データをもとに、アウトプットを新たに「生成」しているという点に大きな特徴があります。このような特徴から、生成AIには、学習データの制約を受けずに独自の表現やアイディアを生成することができるというメリットがあります。一方で、出力結果のクオリティをコントロールすることが難しいというデメリットもあります。

また、生成AIは、その種類により生成できるコンテンツには文章や画像、音声、3Dモデルなどさまざまなものがあります。このうちChatGPTに搭載されているGPT(Generative Pre-trained Transformer)は、文章生成等の自然言語処理に特化した大規模言語モデルであり、質問への回答や文章の要約、テキストデータの分類などいった自然言語処理タスクに適しています。

その上で、ChatGPTはユーザーとの「対話」という特定の目的のためにGPTをファインチューニングすることで、まるで人間と会話しているかのような自然な会話表現による回答の自動生成を可能にしています。

ChatGPTの商用利用は可能だが、注意点も多い

ChatGPTを含むOpenAI社のサービスは、商用利用が可能であることが利用規約上に明記されています。したがって、ChatGPTはさまざまな業務に活用することができ、これによる業務の効率化とコストの削減が期待されています。例えば、前述のChatGPTの特徴からすれば、次のような業務への活用が有効です。

また、APIも公開されていることから、ChatGPTをそのまま利用するだけでなく、自社のサービスやアプリケーションにChatGPTを組み込むことも可能です。自社独自の機能やサービスとChatGPTの機能を組み合わせることにより、活用の幅は今後さらに広がるものと思われます。

ただし、ChatGPTを商用利用する場合には一般論として、以下の点に注意しなければなりません。

著作権侵害の危険性がある

利用規約上、ChatGPTに入力または出力されたコンテンツに関する全ての権利は、ユーザーに帰属するものとされていますが、他者の著作権を侵害する場合などは除かれています。どのような場合に著作権侵害となるかを含め、生成AIと著作権に関する考え方については、過去記事「生成AIで書くソースコードの著作権をどう考えるべきか?元ITエンジニアの弁護士が徹底解説」で詳しく解説しているので、この点については、上記記事をご参照ください。

情報漏洩の危険性がある

ChatGPTに入力された情報は、原則として機械学習に利用されてしまいます。そのため、ChatGPTを商用利用する場合には、企業秘密や個人情報の取扱いには特に注意する必要があります。生成AIの利用に伴う企業秘密や個人情報の管理・漏洩の法的問題については別の記事で解説しますが、企業秘密や個人情報が機械学習に利用されてしまうと、場合によっては法的問題に発展する可能性もあります。なお、ユーザー側が「Chat History & Training」の設定をオフにすることで、ChatGPTに入力した情報を機械学習に利用させないようにすることができます。

情報が不正確である危険性がある

ChatGPTで生成される回答は、学習データをもとに確率的・統計的に見て「それらしい」ものにすぎず、必ずしも正確である保証はありません。

また、ChatGPTは学習期間内(2021年9月まで)のデータをもとに文章を生成しているため、生成される文章には最新の情報が反映されていない場合があります。そのため、ChatGPTを活用する場合には、入力する情報が学習期間内であることが明らかであるか、もしくは学習期間にかかわらない普遍的なものであることが望ましいでしょう。

守るべき規約上の3つの注意点

以上のようなことは、実は規約の中に明記されてはいるのですが、知らないまま利用してしまうと、取り返しのつかない事態になりかねません。そこで以下では、上記以外に特に気を付けるべき規約上の注意点について解説します。

なお、前提として規約の構造についてですが、ChatGPTに限らずOpenAI社が提供するサービスには、共通する規約としての「Terms of Use」が存在し、その下位規範として、個別の規約やポリシー等の各種ドキュメントが存在する構造となっています。各種規約やポリシーの一覧は、こちらをご参照ください。

AI生成物であることの明示

各種規約において、AIを利用した生成物である旨を明示することが求められています。

例えば、「Terms of Use」ではAI生成物について、あたかも人間が生成したものであるかのように表示することが禁止されています。しかし他方で「Brand guidelines」では、「AIが書いた(AIによって書かれた)」というような表記も適切ではないとされています。つまり、人間とAIのいずれかが自律的に生成したかのように表記することは適切ではなく、あくまで「人間がAIを利用して生成した」という旨の表記である必要がある、ということです。具体的には、「Written with ChatGPT」や「Caption written with ChatGPT」などと表記することが推奨されています。

また「Service Terms」では、法律・金融・医療等の専門領域において、チャットボット等の自動化されたシステムにAIを利用する場合には、AIが介在している旨を明示することが利用条件とされています。

さらに「Sharing & publication policy」でも、ソーシャルメディアやライブストリーミングサービス上でプロンプトや出力結果を共有する場合には、プロンプトや出力結果に関する権利がユーザーに帰属すること、及び、出力結果がAI生成物であることを示すことが求められています。加えて、コンテンツの一部にAIを利用した場合であっても、当該コンテンツの作成にあたりAIが担った役割について詳述することも求められています。

「○○GPT」というコンテンツ名の利用禁止

「Brand guidelines」では、APIを利用したコンテンツ名の表記に関するルールが設けられています。具体的には、ChatGPT APIを利用したコンテンツに「◯◯GPT」という名称を付けることは禁止されており、代わりに「Powered by GPT-4」や「Powered by ChatGPT API」という旨の表記が適切であるとされています。

その他にも「Brand guideline」では、ChatGPT用のプラグインの表記に関するルールやパートナーシップを結んでいるかのような表現をしようしてはならないなどの記載があります。

以上のように、ChatGPTを利用してコンテンツを作成する場合には、当該コンテンツの表示方法に関して細かなルールが設けられている点に注意する必要があります。

法律・金融・医療等の専門分野における利用

ChatGPTを利用して作成するコンテンツの内容についても制限があります。例えば、「Usage Policies」では、以下の目的でChatGPTを利用することが禁止されており、項目ごとに具体例が示されています。

- ・違法行為

- ・児童の性的虐待の素材、または児童を搾取または害するコンテンツ

- ・憎悪、嫌がらせ、または暴力的なコンテンツの生成

- ・マルウェアの生成

- ・コンピュータ システムを妨害、損傷、または不正アクセスするように設計されたコードを生成しようとするコンテンツ

- ・身体的危害のリスクが高い活動

- ・経済的損害のリスクが高い活動

- ・詐欺行為または欺瞞行為

- ・アダルト コンテンツ、アダルト産業、出会い系アプリ

- ・政治的キャンペーンまたはロビー活動

- ・人々のプライバシーを侵害する行為

- ・無許可の法律実務に従事すること、または有資格者が情報を確認することなく個別の法的アドバイスを提供すること

- ・有資格者が情報を確認することなく、個別の金融アドバイスを提供すること

- ・誰かに特定の健康状態があるかどうかを伝えること、または健康状態を治す方法や治療する方法を説明すること

- ・リスクの高い政府の意思決定

ここで特に注意すべきは、法律・金融・医療などの専門的知識が必要とされる分野においてChatGPTを利用する場合です。具体的には、法律・金融分野に関する個別のアドバイスを提供する場合には、ChatGPTの出力結果を唯一の根拠として依拠することが禁止されており、必ず有資格者による確認または検討が必要である旨が定められています。また、特に医療分野に関しては、重大な病状の診断または治療においてChatGPTを利用すること自体が禁止されています。

また、上記のような専門分野にChatGPTを使用する場合には、さらに追加の条件として、AIが使われていること、また、潜在的な限界があることによる免責事項を表示することも求められています。

守るべきルールを把握し、適切な利用を

ここまで解説してきたとおり、ChatGPTは、確率的・統計的に見て「それらしい」回答をしているに過ぎず、学習データが正確だからといって生成される結果までもが正確である保証はありません。このような特徴からすれば、上記のような人の生命や身体、財産等に関わる分野においては特に、ChatGPTの回答のみを根拠として利用することは当然避けるべきものと言えるでしょう。

とはいえ、仮に上記のように利用したとしても直ちに違法となるわけではなく、規約違反として、単にChatGPTを含むOpenAI社のサービスを利用できなくなるだけかもしれません。しかし近年では、さまざまな業界や企業内部で「AI倫理」や「AIガイドライン」などと呼ばれる独自のルールが策定される例も増えてきました。これらは法律ではなくとも「守るべきルール」であることには変わりません。そのため、当該業界や企業に関わる以上は、法律や規約と同じく、こうしたルールにも注意しておく必要があるでしょう。

関連記事

【新連載】生成AIで書くソースコードの著作権をどう考えるべきか?元ITエンジニアの弁護士が徹底解説

生成型AIのネクストステージ。セキュリティが保証された小規模な特化型大規模言語モデルの可能性【テッククランチ】

【ChatGPT活用事例】一部の投資家は日常業務にChatGPTを活用。ただし、導入に慎重な声も【テッククランチ】

人気記事