最新記事公開時にプッシュ通知します

自分が写る写真を画像生成AIから守る。予め写真に「毒」を盛り、学習されても違う画像を出力させる技術 ベトナムの研究者らが開発

2023年4月12日

先端テクノロジーの研究を論文ベースで記事にするWebメディア「Seamless/シームレス」を運営。最新の研究情報をX(@shiropen2)にて更新中。

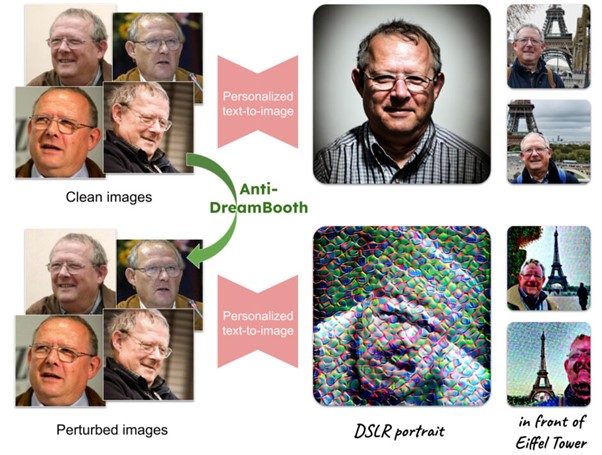

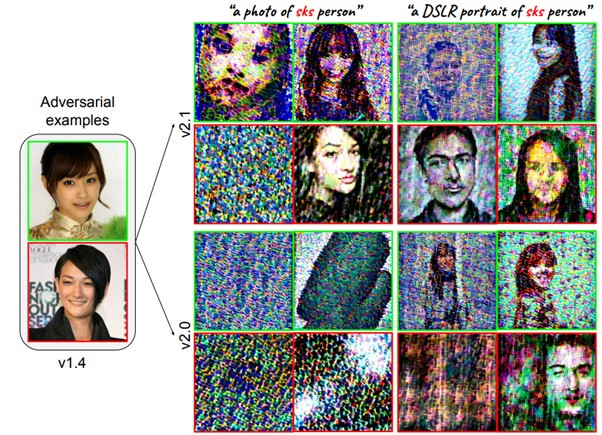

ベトナムのVinAI Researchに所属する研究者らが発表した論文「Anti-DreamBooth: Protecting users from personalized text-to-image synthesis」は、テキストから画像を生成する拡散モデルに悪用されないために、自分の顔が写った画像を防御する手法を提案した研究報告である。自分が写った画像をネット上に公開する前に、敵対的ノイズ(摂動)をその画像に注入する。これにより画像生成モデルがその顔を学習し、悪意ある画像を生成しても、非常にパフォーマンスの悪い画像が生成される。

研究背景

ここ数年の間に拡散モデルが画像生成研究に革命をもたらし、リアルな品質と多様なコンテンツを持つ画像を生成できるようになった。テキストから画像への拡散モデルはデザインスキルがなくても、誰でも簡単なテキスト入力からリアルな画像の生成を可能にする。

さらに、「DreamBooth」のような強力なパーソナライズツールを使えば、特定の人のさまざまなバージョンの画像を複数作り出すこともできる。DreamBoothとは、3~5枚程度の同じ人の異なる画像を入力にテキストから画像を生成する拡散モデルを事後学習(微調整)した技術である。

特定の人のいくつかの参照画像を学習するだけで、その人の合成画像を簡単に生成できる。品質も高くフォトリアリスティックな合成画像は、実際の写真と見分けがつかないこともある。そのため、この強力で便利なツールが悪意で使われると、フェイクニュースや個々の被害者を標的とした迷惑コンテンツを生成し、社会に深刻な悪影響を及ぼす可能性がある。

研究内容

このような特定の人物の合成画像においてGAN(Generative Adversarial Network)ベースのDeepFakeの脅威はよく知られており、多くの研究者の関心を集めているが、DreamBoothのような拡散モデルに対しての脅威はまだ注目されていない。

そこで本研究では、悪意のあるパーソナライズされた画像生成モデルからユーザーを保護する手法「Anti-DreamBooth」を提案する。公開前の画像に敵対的ノイズを注入することによって、DreamBoothの脅威から各ユーザーを積極的に防御する。

この敵対的ノイズは、学習させたDreamBoothモデルが、被写体の妥当な品質の画像を生成できないように設計されている。GANベースのDeepFakeを防御する技術に触発されているが、拡散ベースのテキストから画像へのモデルとDreamBoothの複雑な定式化のために、異なる性質を持つ。

GANベースの防御技術では、防御者は固定されたDeepFakeジェネレーターをターゲットに、単一画像の敵対的ノイズを最適化するが、Anti-DreamBoothでは、摂動画像そのものから未知の生成器を破壊するために、敵対的ノイズを最適化する。

研究者らは、これらを可能にする敵対的ノイズ生成のためのアルゴリズムを設計した。このアルゴリズムは、オリジナル画像に対して、拡散モデルのノイズ除去の各ステップで悪いパフォーマンスを出力するように機能し、最終的にオリジナル画像の低品質画像を生成する。

例えば、顔の輪郭程度は残るが誰だか特定できない画像や、強烈なエフェクトで加工されたような画像、原型を留めない画像など、条件によってさまざまな結果が出力される。

実証実験

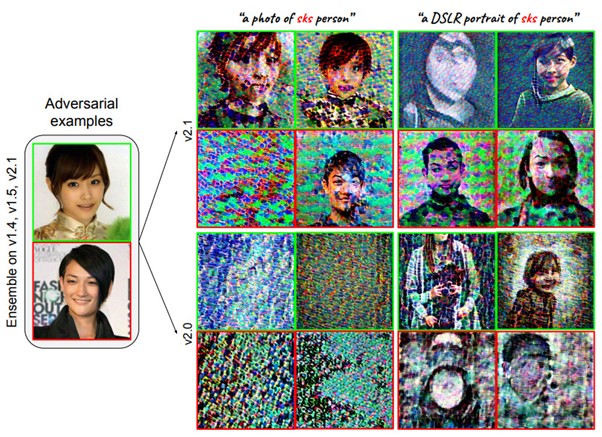

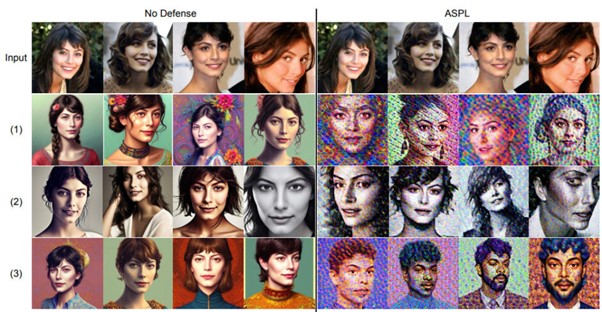

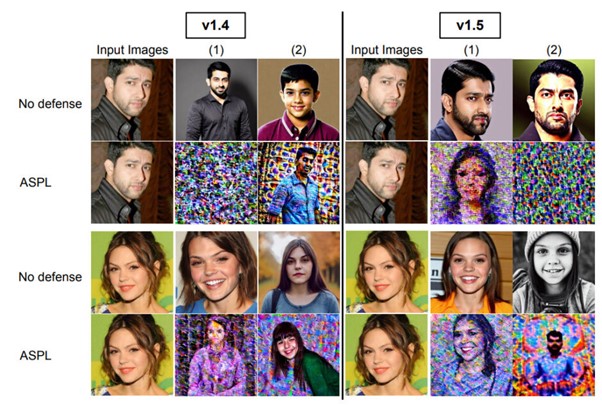

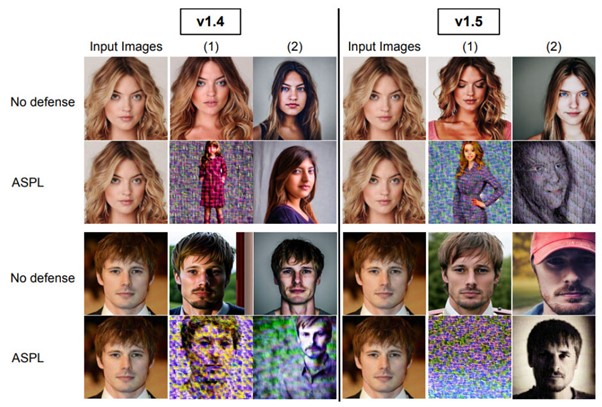

実験では、顔のベンチマーク2種類でDreamBooth攻撃を防御するための有効性を検証した。提案するアルゴリズムは、制御された設定において、全てのDreamBoothの試みを破ることに成功し、生成された画像には顕著な視覚的アーチファクトを生じさせることができた。

提案した防御法は、異なるテキストから画像へのモデルや異なるトレーニングテキストを使用した場合でも、一貫した効果を示す。さらに、訓練とテストの間のモデルやプロンプトの不一致のような悪条件でも、提案手法はその効果を維持する。

Source and Image Credits: Van Le, Thanh, Hao Phung, Thuan Hoang Nguyen, Quan Dao, Ngoc Tran, and Anh Tran. “Anti-DreamBooth: Protecting users from personalized text-to-image synthesis.” arXiv preprint arXiv:2303.15433 (2023).

関連記事

「自分の絵を画像生成AIから守る」――学習される前に絵に“ノイズ”を仕込みモデルに作風を模倣させない技術「Glaze」【研究紹介】

OpenAIがGPT-4を公開。画像処理できる最先端の生成AI【TechCrunch】

一部の投資家は日常業務にChatGPTを活用【テッククランチ】

人気記事