最新記事公開時にプッシュ通知します

LayerX CISOに聞く、AI全社推進に求められる情報セキュリティガバナンスの考え方【Bet AI Day】

2025年9月9日

株式会社LayerX 執行役員 CISO

星 北斗

2013年にクックパッド株式会社に新卒入社。セキュリティ、SRE、コーポレートエンジニアリングを主領域とし、技術本部長、海外本社出向などを経て2023年にCTO兼CISOに就任。2024年1月にLayerX入社。クラウドとセキュリティと料理が好き。

かつてパーソナルコンピュータやインターネットが社会を根底から変えたように、今、AIが私たちの働き方や価値創造のあり方を大きく変えようとしています。LayerXは、この変革期に行動指針を「Bet AI」にアップデートして、プロダクトから文化まで全てをAI中心に再設計する挑戦を始めました。

本稿では、LayerXでCISOを務める星北斗氏に、これからの「大AI時代」を牽引する企業に求められるセキュリティガバナンスのあり方、全社的なAI活用を実現するオンボーディングの仕組みづくり、そしてその双方を支えるオープンな文化を醸成する方法を教えていただきました。

「大AI時代」のセキュリティガバナンス:「コントロール」から「リスクの受容」へ

なぜ今、セキュリティの考え方を変える必要があるのか

ChatGPTの登場を境に「AI利活用」という言葉が持つ意味は大きく変わりました。プロンプトを通じて誰もがAIと直接対話できるようになった今、その利用者は爆発的に増加しています。

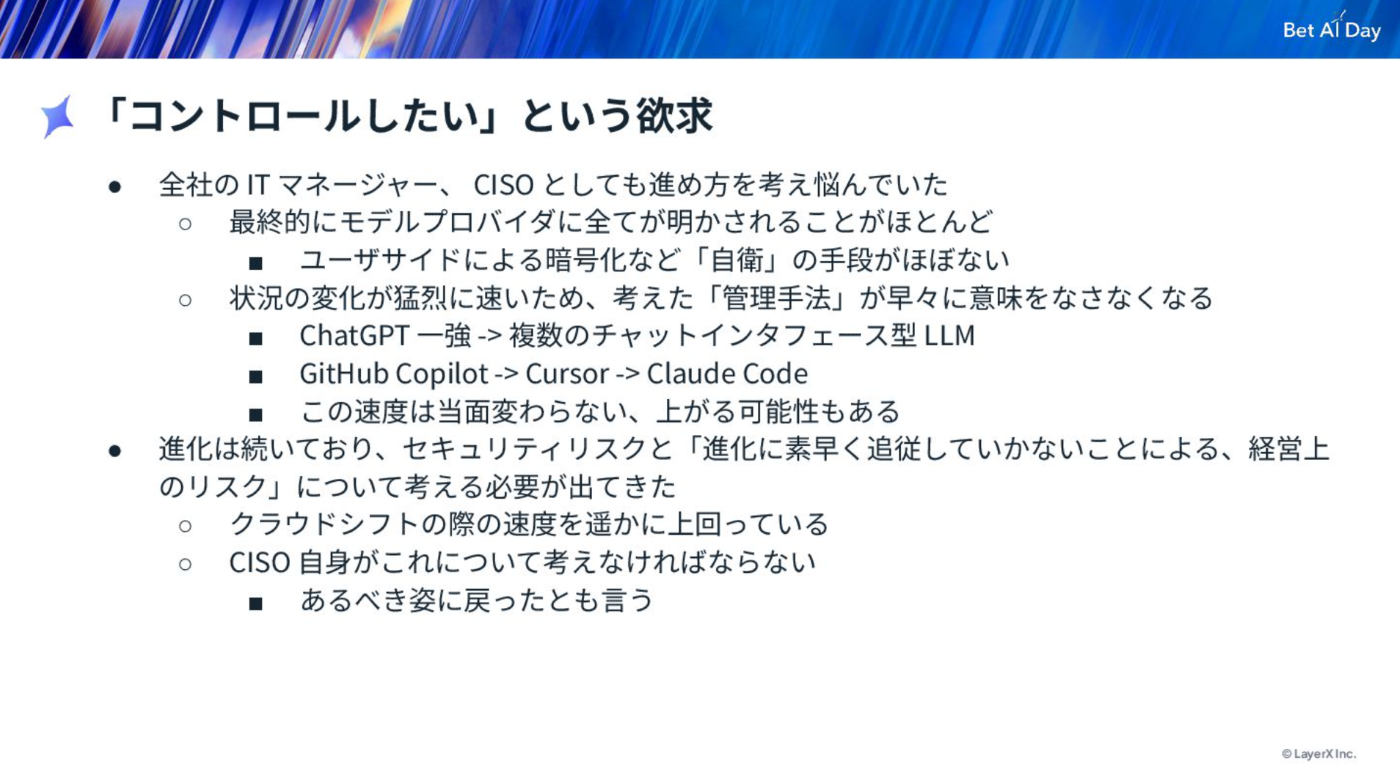

この変化は、組織の情報セキュリティが拠り立つ前提を揺るがしています。これまでは「大体のことはコントロールできる」という暗黙の前提の上に成り立っていましたが、これからは「すべてを完璧にコントロールすることは不可能である」という現実を受容する必要があります。その理由として、主に以下の2点が挙げられると思います。

第一に、AIとの対話が「平文」を介して行われるという技術的な特性です。

LLMアプリケーションは、意味のある回答を得るために暗号化されていないテキストデータをAPIを通じてモデルプロバイダに提供します。これは、データを暗号化したまま処理を委託するといった選択肢もある従来のクラウドサービスとは根本的に異なり、送信するデータの機密性を自社で完全に管理しきれないことを意味します。

第二に、圧倒的なスピード感で変化する技術トレンドに、従来の管理体制では追いつけないという現実です。

毎日のように新しいAIツールやサービスが登場し、市場のトレンドは数ヶ月単位で激しく移り変わります。このような環境下で従来のガバナンス体制づくりのように、特定のツールを前提とした厳格な管理体制を時間をかけて構築しても、完成した頃には技術のトレンドが変化し、その体制自体が陳腐化してしまうのです。

完璧なコントロールを諦め、取るべきリスクを見極め、受容する

AIツールの進化の速さは、かつてのクラウドシフトの時よりも圧倒的に速く、そのなかでセキュリティリスクのコントロールがより難しく、よりクリティカルなものだと感じています。こうした状況で、AI利用のセキュリティリスクに向き合う一方で、スタートアップとして、この進化に乗り遅れることによる経営上のリスクも直視しなければなりません。CISOとしてこの2つのリスクを常に天秤にかけ、バランスを模索し続けています。

そこでLayerXは、全てを完璧にコントロールしようとする考え方から離れ、「いい意味で諦められるラインを探す」というアプローチに切り替えました。このラインを引くために、LayerXでは守るべき情報の優先順位を明確にしており、そのなかで、最大限にコントロールできる環境で扱う、一切のリスクが許されない「聖域」を定義しています。

・ 最大限にコントロールできる環境で扱う、一切のリスクが許されない「聖域」

顧客データやそれに準ずる機微な社内情報(人事評価、未公開の経営情報など)がこれにあたります。この領域は会社の信頼の根幹であり、いかなる場合も守り抜かなければならない「聖域」です。そのため、環境や規約が完全に整備された制御済みのアカウントでのみAPIを利用するなど、厳格なポリシーの下でのみ扱われます。

・ 「何かあっても我々が泣けば済む」情報

これは、万が一インシデントが起きてもその影響が社内に留まり、お客様にご迷惑をおかけしないと判断できる領域を指します。ここは、事業成長のために積極的にAIにBetすべき部分だと割り切り、利用ルールの策定も現場の判断を最大限尊重します。ただし、現場が判断に迷う際は、セキュリティチームが直接ジャッジし、事業のスピードを阻害しない体制を整えています。

このように、守るべき一線を明確に定めた上で、許容できる範囲のリスクは積極的に取れるように環境を整備する。その中で、難しい個別事案は専門チームが直接判断し、AIのセキュアな利用に対する解像度を高めながらAIとともに事業を推進しています。

全社AI活用を加速させるオンボーディングの仕組みづくり

LayerXでは、セールスからコーポレートまであらゆる部門の業務にAI活用が浸透しています。

AIの導入は既存の業務プロセスの置き換えを伴うため、大きな「変化のためのエネルギー」が必要です。しかし、「どこから始めればいいのか」「予算はどう確保するのか」といった数々の壁が、そのエネルギーを削いでしまうのです。

私たちは、これらの「壁」を一つひとつ取り払うべく、多くの施策を実施してきました。本日は、その中から代表的な3つの取り組みを紹介します。

1. 「最初の一歩」を踏み出すハードルを下げる

まず注力したのは、普段開発ツールに馴染みのない社員が気軽にAIツールに触れられるように、AIを使い始めるためのハードルを下げることです。具体的には、全社で利用するツールをChatGPTのTeamプランから、より多くの社員が日常的に利用するGoogle Workspaceに付帯するGeminiに切り替え、環境整備をしました。

さらに、自発的にAI活用を進めていた社員へのヒアリングをもとに、「実際の業務課題をどうAIを活用して解決したか」という具体的な事例を集め入門コンテンツを作成し社内に展開。その結果、AIを頻繁に使うヘビーユーザーは2倍近くに増加するという結果が出ています。

2. 自由にカスタマイズできるプラットフォームを展開

次に、社員が「自分たちの課題を、自分たちで解決できる手段」を提供することを目指し、ソースコードが公開され、自社環境で安全に運用できるDifyやn8nといったセルフホスト型のプラットフォームを展開しました。これらのツールを自社のAWS環境内に閉じて運用し、自社のSSO(シングルサインオン)基盤と連携させることで、外部へのデータ送信リスクを管理しながら、誰もが安全に利用できる基盤を構築しました。

もちろん、こうしたプラットフォームも「場を用意するだけ」では利用者が増えません。各チームに推進リーダーを置き、ワークショップを定期開催するなど、利用を能動的に促す取り組みも同時に行っています。

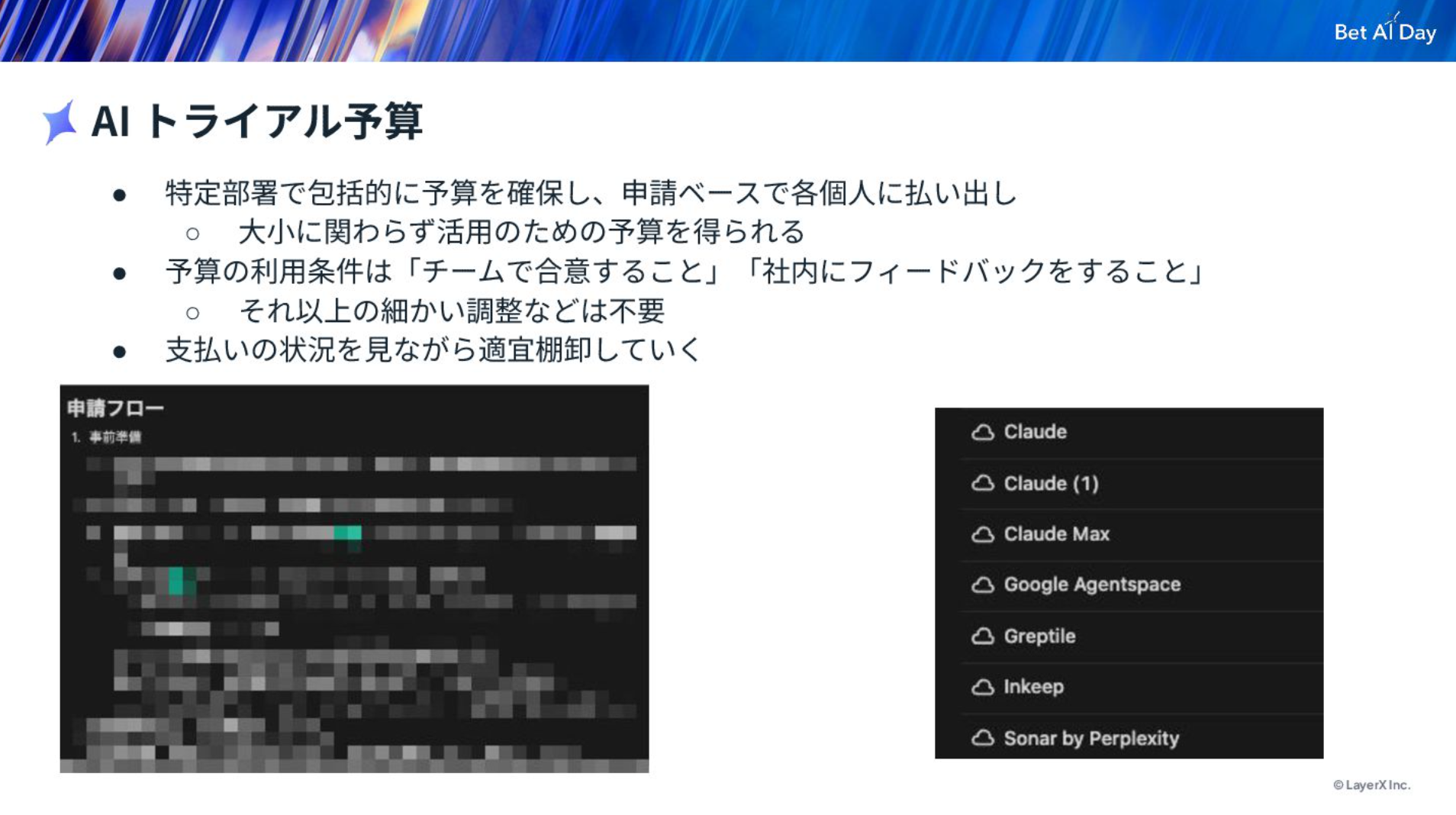

3. 急速な進化に対応する「AIトライアル予算」

最後に、AIの目まぐるしい進化にどう対応するかという課題です。特定領域に特化したAIサービスが次々と現れる中で、特定のチームが全てを追いかけ、評価・管理するのは限界があります。

そこで、社員一人ひとりが分散的かつ統制が取れた形で新しいAIサービスを試せるように「AIトライアル予算」という制度を設けました。

これはコーポレート部門が年間で包括的な予算を確保し、現場からの申請に応じて個別に利用料金を払い出す仕組みです。申請条件は「チーム内で合意が取れていること」と「利用結果を社内にフィードバックすること」の2点のみ。セキュリティに関しても、サービスの開発元の所在地や利用・学習ポリシーなど確認すべき要件をチェックリスト化して公開し、現場でもセルフチェックできるようにしました。

これにより、煩雑な稟議プロセスなしに、セキュリティ部門による事前確認を経たうえで、迅速に新しいツールを試せるようになりました。

これらの仕組みを通じ、課題を最も深く理解する現場の当事者が、自らの手で業務改善を実現するケースが続々と生まれています。例えば、人事担当者が自らコードを書き、「就労証明書」の発行を半自動化したり、営業チームがn8nを用いて商談の割り振りを自動化し、月に数十時間の工数を削減したりといった成果が出ています。

思考と仕組みを最大限に活かす、オープンなコミュニケーション

ここまで、AI時代における私たちの考え方や、具体的な仕組みについて紹介しました。しかし、これらが真に機能するための土台が「気軽にシェアする、聞く、助ける」というLayerXに根付く文化です。チームの成功事例が瞬時に社内でシェアされ、事業部の壁を超えていく。この活発な情報交換が、プロダクトや事業部間の相乗効果を生み出しているのです。

その文化の原点にあるのは、私自身も常に心がけている「社内で起きているあらゆる相談事に、とにかく首を突っ込む。そして、それを外からも見えるようにする」という考えです。

役職者などが率先してあらゆる相談に顔を出すことで、「この相談は(他事業部・他プロダクトの人からも)答えていいんだ」という発言しやすい雰囲気をつくる。それと同時に、具体的な「場」を設計することも重要です。LayerXにはセキュリティ委員会のチャンネルや、AI活用に関するチャンネルが多数存在し、私を含む専門家がいつでもサポートできる体制を整えています。そこでは、初心者が「こんなことを聞いていいのだろうか」と萎縮しないように周囲から率先して声をかける「適切なおせっかい」を焼く光景が日常的に見られます。

さらにこの文化は、CISOの視点から見ても、セキュリティガバナンスに非常に良い影響をもたらします。ツールの利用や情報の扱いについて誰もが気軽に相談できる文化は、意図せぬルール違反を未然に防ぎ、結果的に組織全体のリスクを効果的に抑制しています。

現場によるセルフチェックと、私たち専門チームによる迅速な判断。この二つが組み合わさることで、事業の成長を妨げない、しなやかで強靭なセキュリティ体制が実現できるのです。

関連記事

なぜLayerXは「Bet AI」に舵を切ったのか。AIファーストな組織を支えるアーキテクチャ【Bet AI Day】

未経験からPdMになれる人が持つ素質とは?積極採用するLayerX VPoPに聞く「見極めと育成」

エンジニア不足は「業界全体」の問題。LayerX松本CTOに聞く「自走できるエンジニア不足」から脱する方法

人気記事

![App Router時代における「大規模React開発」のフォルダ設計術。Colocationによる関心の分離[レバテックLAB]](https://levtech.jp/media/wp-content/uploads/2025/09/250902_LTlab_column.png)