最新記事公開時にプッシュ通知します

写真から「立体的なアート作品」をAIが自動作成 米Adobeなどが開発【研究紹介】

2022年6月21日

先端テクノロジーの研究を論文ベースで記事にするWebメディア「Seamless/シームレス」を運営。最新の研究情報をX(@shiropen2)にて更新中。

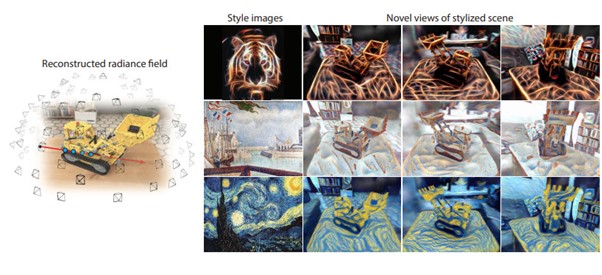

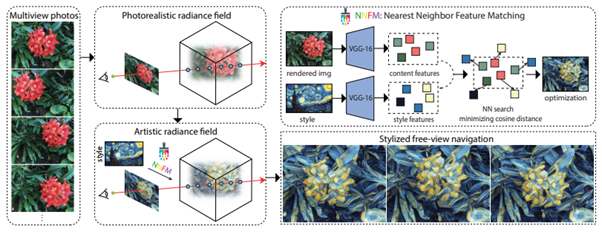

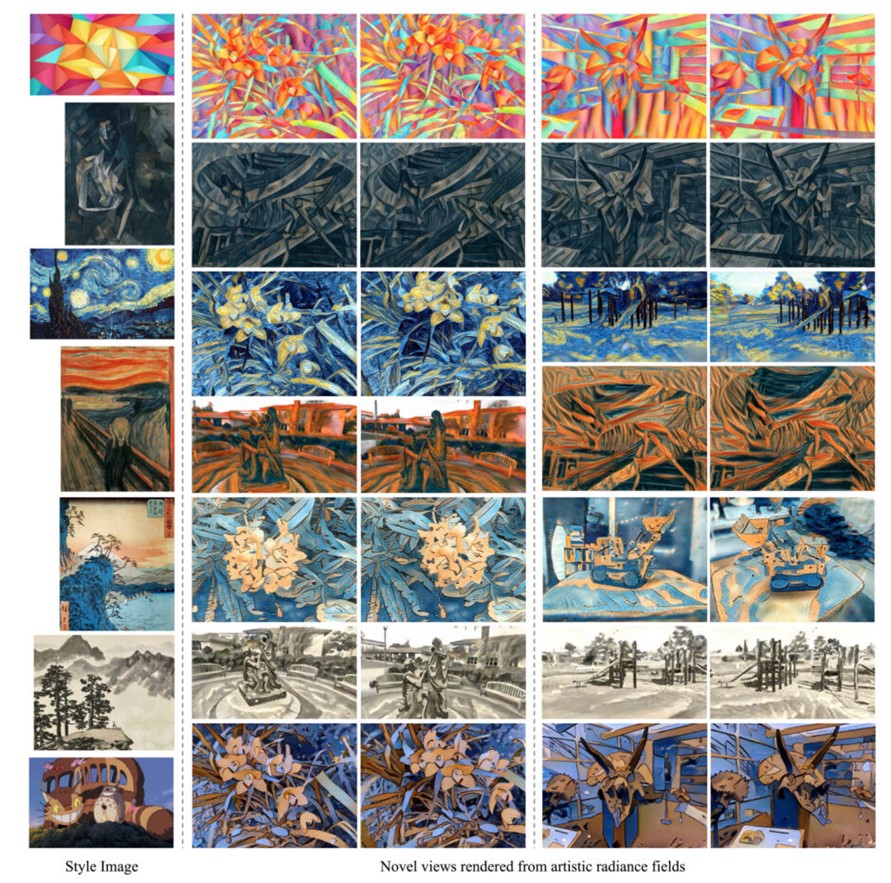

米Cornell Universityと米Adobe Researchの研究チームが開発した「ARF: Artistic Radiance Fields」は、撮影した写真を立体的なアート作品に変えられる、機械学習を用いたスタイル変換技術だ。立体にしたい画像と模様にしたいスタイル画像を組み合わせて、どの方向からでも自然に見える3Dオブジェクトを生成する。色調など細部までスタイルを忠実に模倣した、自由視点の3Dシーンに仕上げる。

研究背景

芸術的なアニメーション制作には、多くの場合、多大な時間と特別な専門知識が必要だ。アニメーションの場合は時間、バーチャル環境の場合は3D空間など、2D画像を超える次元に作品を拡張することは新しい制約と課題をもたらす。

点群やメッシュに対して3Dスタイライゼーションを行うこれまでの手法は、複雑な実世界のシーンに対して再構成誤差の影響を受けやすく不自然な出力結果になっていた。

今回、研究チームは「NeRF(Neural Radiance Field)」ベースのニューラルレンダリングを用いて2D画像から実世界の3Dシーンに芸術的特徴を転送し、3Dアートに仕上げるアプローチ「Artistic Radiance Fields(ARF)」を提案する。

研究過程

ARFの肝となる技術NeRFとは、異なる角度から撮影した複数の画像データを入力に新しい視点の画像、自由視点画像を生成するボリュームレンダリングのことを指す。NeRFモデルに座標とカメラの方向を入力すると、色と密度(不透明度)が出力されるのがこのモデルの基本技術で、取得した色と密度を用いてボリュームレンダリングを行うことで立体的な画像を生成する。

その際に、空間上の各座標に色と密度を対応付けた場を「Radiance field(輝度場)」と呼ぶ。このRadiance fieldをスタイル画像から抽出された特徴量と照合することで、Radiance fieldを芸術的なスタイルに変換して高品質な新規ビュー合成を実現する。

具体的には、局所的なスタイル構造を詳細に伝達できる「Nearest neighbor feature matching(NNFM)」スタイル損失を用いてRadiance fieldを微調整することにより達成される。またGPUのメモリが限られている中で、フル解像度画像によるRadiance fieldの最適化を可能にするDeferred back-propagationを導入し、さらにView-consistent color transfer技術を適用して最終的なビジュアル品質を向上させる。

実証実験

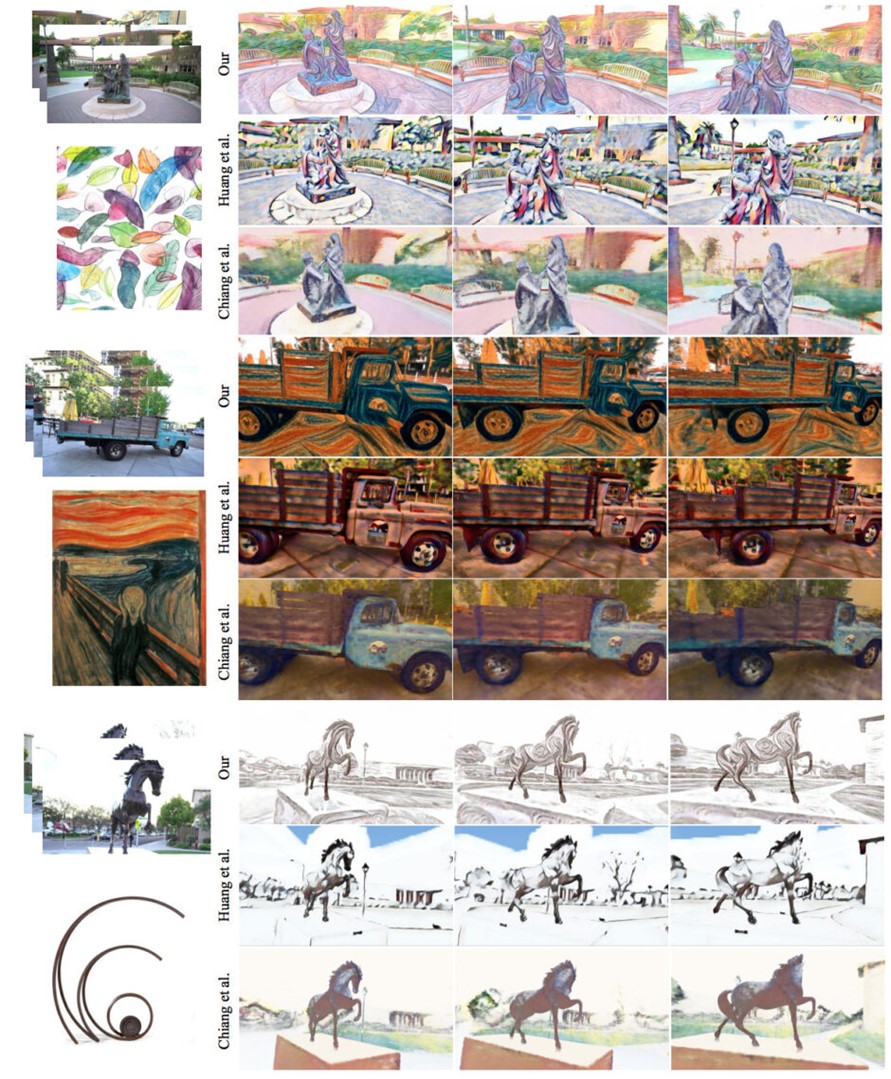

実験では、ベースライン手法との定量的・定性的な比較を行うことで、本手法を評価する。結果は、本方法が元のシーンの認識可能な意味的・幾何学的特徴を維持しながら、入力スタイル画像により忠実なスタイル化レンダリングを生成するという点で、ベースライン手法を大幅に上回っていることを示した。

今回のスタイル変換は自由視点で出力されるため、精度をより直感的に理解するためにプロジェクトページで動画を参照されたい。

Source and Image Credits: Zhang, Kai, Nicholas I. Kolkin, Sai Bi, Fujun Luan, Zexiang Xu, Eli Shechtman and Noah Snavely. “ARF: Artistic Radiance Fields.” (2022).

関連記事

AIが大学レベルの数学を即座に解き、高品質な問題の生成にも成功。プログラム合成技術を活用 MITなどが発表【研究紹介】

VR空間に籠もって仕事ができる個室 部屋内で起きる実世界の出来事をリアルタイム再現・後から3D再生可能に【研究紹介】

VRヘッドセットの脆弱性を指摘 装着者の顔の動きから個人情報を抜き取るシステムを開発【研究紹介】

人気記事