最新記事公開時にプッシュ通知します

生成AIは「意味」を理解しているのか?「ノリ」で喋れるLLMに、決定的に欠けているものとは

2024年12月3日

京都大学大学院情報学研究科教授/立命館大学総合科学技術研究機構 客員教授

谷口 忠大

1978年生まれ。京都大学工学研究科博士課程修了、博士(工学)。専門は人工知能、創発システム、認知発達ロボティクス、コミュニケーションの場のメカニズムデザイン。全国に広まる書評ゲーム「ビブリオバトル」の考案者でもある。

著書に『コミュニケーションするロボットは創れるか―記号創発システムへの構成論的アプローチ』(NTT出版,2010)、『記号創発ロボティクス 知能のメカニズム入門』(講談社,2014)、『心を知るための人工知能 認知科学としての記号創発ロボティクス』(共立出版,2020)、『ビブリオバトル 本を知り人を知る書評ゲーム』(文藝春秋,2013)、共編著書に『コミュニケーション場のメカニズムデザイン』(慶應義塾大学出版会,2021)、『未来社会と「意味」の境界 記号創発システム論/ネオ・サイバネティクス/プラグマティズム』(勁草書房,2023)など。近著は『記号創発システム論 来るべきAI共生社会の「意味」理解にむけて』(新曜社,2024)。

日常生活の中で、あるいは仕事の中でAIと“コミュニケーション”を取っているという人は少なくないでしょう。AIは私たちが入力する言葉を「理解」し、その言葉に応じた適切なリアクションを返してくれているように思います。

しかし、本当にAIは私たちの言葉の意味を「理解」しているのでしょうか。巷には「AIは人間の言葉を『理解』していない」とする意見もあります。だとすると、AIはいかにして私たちとのコミュニケーションを実現しているのでしょうか。

本記事では、「記号創発システム論」を提唱し、言語を含む「記号」創発の仕組みの解明に挑む、谷口忠大さんにインタビューを実施。谷口さんが取り組む「記号創発システム論」を足がかりに、「意味の理解」を巡るAIの現状と諸問題について聞きました。

「AIの意味理解に関する問題としてしばしば言及される『記号接地問題』は、問題の本質ではない」と谷口さん。AIによる意味理解、そしてAIとの共生の鍵はどこにあるのでしょうか。記号、言語、意味、身体、知能……さまざまなテーマが絡み合う、AI研究の最先端を覗いてみましょう。

- AIは「意味」を理解しているか?

- 「記号接地問題」は、問題ではない?

- 身体をもたない存在は、いかに「理解」を示し「言葉」を獲得するのか

- AIは、あらゆる動物の「逆方向」から進化している

- 「AIは賢くなったけど、人間は賢くなっていない」では意味がない

AIは「意味」を理解しているか?

——まず、谷口さんが中心となって立ち上げた「記号創発システム論」について教えてください。

谷口:記号創発システム論は、私自身の知能の探求の中で見出した視点ですが、言語学や心理学、あるいは哲学などの人文・社会科学に関する学問や、AIやロボティクスといった情報・工学系の学問に関する知を融合し、「記号の意味がどのように成立しているのか」を探求する学問です。

谷口:記号とは、僕たちが何かを表し、意図を伝えるために出す、あるいは僕たちが何か意味を読み取る対象としての信号(サイン)のことを指します。いまこうして話している「言語」も記号の一種です。

コミュニケーションに言語は欠かせませんが、言語だけでコミュニケーションが成り立っているわけではないですよね。いまオンラインミーティングツールの画面には、インタビュアー以外の方も映っていますが、その画像もまた遠くにいる誰かを表す類像的なサインです。映っている人々は何も言葉を発していないけれど、何度も頷きながら僕の言葉を聞いてくれています。こういった、いわゆるボディーランゲージもやはり記号の一つです。

僕たちのすべてのコミュニケーションは、そういったさまざまな記号と、その意味が人々の間である意味で「揃うこと」によって成り立っています。これは考えてみれば不思議なことで、僕たちはいつの間にか「くびを縦に振ること」が「肯定や理解を示すこと」だとわかっている。

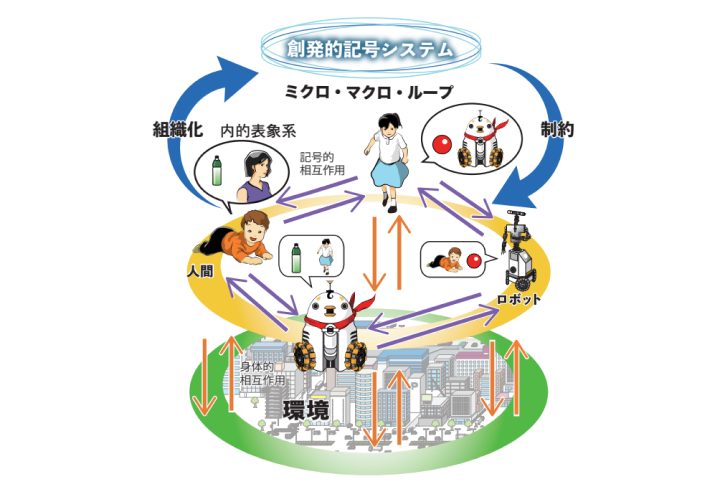

つまり、社会の中で、あるいは個人の認知システムの中で、記号を生み出し、意味を揃える「記号創発」のメカニズムが働いているわけですね。そのメカニズムを支える社会と認知の結合システムの総体を「記号創発システム」と呼び、それらの根本原理を探求するのが「記号創発システム論」です。

——LLMと“コミュニケーション”を取っている人も少なくありません。ずばり、LLMは私たちの言葉、すなわち記号の意味を「理解している」といえるのでしょうか。

谷口:玉虫色の回答になってしまって申し訳ないのですが、「ある側面では理解しているし、ある側面では理解していない」というのが、現時点での答えです。

その問いを考えるにあたっては、「意味」と「理解」という言葉の定義が重要になるわけですが、これまで僕たちはそれらの言葉を何となく使ってきたところがあるのではないでしょうか。

哲学や言語学ならまだしも、特に工学的な学問の世界においては、「意味」や「理解」を厳密に定義しなくても問題なかったように思います。しかし、生成AIやLLMの登場によって、そうも言っていられなくなりました。「意味」や「理解」の内実を解き明かし、分類し、しっかりと定義しなければ「生成AIは何ができるのか」「LLMをどのように活用すべきか」といった問いに正確な答えは出せません。

たとえば、「理解」の定義を「テキストの内容を正確に捉えて、その内容に基づいた反応をすること」と定義すれば、すでにLLMは「僕たちの言葉を理解している」と言えますよね。でも、それはあくまでもテキストに書いてあることを読み取り、テキストによって回答を返しているだけ。先ほど言ったように、僕たちがコミュニケーションの中で他者の言葉を「理解する」というのは、実世界における経験や他者との関係性、その場が持つ文脈などを踏まえて、言葉を捉えることです。

ですから、LLMに「リンゴとは何ですか?」と質問をすれば、「リンゴとは、果物の一種であり、一般的には赤い果皮を持つ……」と回答してくれますが、LLMはリンゴを食べたこともなければ、見たこともないわけですよね。そういった意味では、「LLMはリンゴを『理解』している」とは言いにくい、という主張もまた成り立ちます。

「記号接地問題」は、問題ではない?

——記号接地問題というやつですね。やはり、LLMを始めとする人工知能はこの問題をのりこえなければならないのでしょうか。

谷口:そこは、専門的には若干難しい問題です。そもそも、問題とされていた記号接地問題は、ある意味で特殊な仮定の元で語られていたと僕は認識しています。昨今、カジュアルに語られる記号接地問題は、ほとんど「言語理解」の問題として捉えられていますが、そもそもの指摘は少し違います。

元々の定義に基づくなら、僕は必ずしも、(元々の意味での)記号接地問題を解く必要はないと思っています。というのも、記号接地問題が提案されたころの古典的な人工知能研究において意味されていた「記号」は、これまでに話してきたような僕たちがコミュニケーションで用いている、いわゆる人文・社会科学分野における記号と違うものを指しているからです。

アレン・ニューウェルなど、初期の人工知能分野の研究者たちは、「知能は『記号』処理によって表現し得る」と考えました。これを「物理記号仮説」と言います。ここで言う「記号」とは、プログラミング言語の中の変数や、コンピューターのメモリ表現として捉えられるべきものです。ざっくり言うと「知能は論理演算、すなわち『真か偽か』の判定の積み重ねによって出来ている」ということですね。この考え方に基づいて設計されたのが、古典的なシンボリックAIです。

単純化して言ってしまえば、古典的な人工知能分野における「記号」とは、元々「コンピューターのための記号」だった。そして哲学者のスティーブン・ハルナッドは、1990年に発表した論文で「物理記号仮説に基づく『記号』システムだけでは、現実の事象は表現できず、あくまでも『記号』と『記号』の関係性から抜け出せない」と指摘しました。これが「記号接地問題」ですね。

ただ、ハルナッドは、あくまでも「コンピューターのための記号」を用いることを前提にした上で、その「記号」をいかに実世界の事象に接地させるかを考えていました。つまり、記号接地問題の前提には、物理記号仮説がある。

では、なぜ記号接地問題を解かなくてもいいと考えているかと言えば、僕はそもそも「物理記号仮説」が間違っていると思っているから。人間の知能が「真か偽か」、言い方を変えれば「0と1」の集積によって成り立っているとは思えません。人間はそんなにロジカルに出来ていないですよ。問題の前提自体が誤っているのであれば、問題は問題として成立しませんよね。

それよりも「実世界に存在し、実際に人間が使用している記号を見よう」と言いたい。僕たちが実世界で用いている記号の意味がどのように創発し、共有されているのか。そのメカニズムを解き明かす方が、人工知能をさらに前進させるためにも、人間理解を深めるためにも重要なことだと思っています。そしてLLMが現在扱っているのは、そういう記号なんです。

——記号接地問題は、AIの意味理解をめぐる問題の本質ではないと。

谷口:そうですね。LLMはリンゴも見たことも食べたこともないという意味で、実世界のリンゴを「理解している」と言えないのは確かですが、それよりも重要なことは、LLMを始めとする生成AIが、シンボリックAIとは違う方法でさまざまな事物を認識しているということです。

シンボリックAIは、単語が持つ意味を固定して学習します。つまり、実世界に存在する物体としてのリンゴと、ラベルとしての「リンゴ」を固定的な対応関係として捉えている。

しかし実世界の事物と、実際に僕たちが使っている記号としての言葉の関係は、文脈によって流動的に変化しますよね。

LLMのすごいところは、その流動的な関係性を踏まえてさまざまな言葉を学習している点にあります。LLMは僕たちが何気なく書いている文章を徹底的に学習して、それを真似ているわけです。つまり、物理記号仮説に基づく“記号”ではなく、本来の意味での記号の痕跡を学習し、適切に記号をアウトプットできるようになった。

僕の認識では、LLMはシンボリックAIを蹴っ飛ばしたんですよ。「その考えは間違っている!人間はそんな風に物事を理解していない!」と。人間が人間とコミュニケーションを取るときの自然な言葉の使い方を学んで、ある種「ノリで」言葉を使えるようになったことが、LLMのすごさです。

身体をもたない存在は、いかに「理解」を示し「言葉」を獲得するのか

——では、LLMの登場によって、機械による人間の言葉の「理解」はかなり進んだということでしょうか。

谷口:進んだのは間違いないですが、コミュニケーションを取りながら「共に生きる」レベルに達しているかと言えば、まだまだでしょうね。

生活のこんなシーンを思い浮かべてみてください。あなたには共に暮らしているパートナーがいて、ある日「明日、用事があるからあなたが帰宅する時間には家にいないと思う」と言われました。次の日、帰宅するとそこにはパートナーがいて、少し驚いたあなたは何気なく「いたんだ」と声を掛けたとしましょう。

この「いたんだ」という言葉には主語もなければ、目的語もありませんよね。でも、この何もない言葉からさまざまな意味が生まれることは、みなさんも経験上よく知っているはずです。

パートナーが「友達と会う予定だったけど、キャンセルになっちゃったんだよね」と答えれば、パートナーは「いたんだ」という4文字を家にいる理由を問うものとして受け取ったことになります。また、2人の関係性が悪い時期であれば「いたんだ」が非難を意味することもあるかもしれない。あなたにはそのつもりはなかったとしても、パートナーはいることをとがめられたような気がして「いて悪い?」と答える。

そんな風に、僕たちの言葉にはさまざまなコンテクストが覆い被さり、多様な意味を生み出します。それらをやり取りすることで僕たちのコミュニケーションは成り立ち、世界は動いているわけですが、きっと現在のAIはまだ「いたんだ」に意味を与えられません。AIがそういった言葉に意味を付与し、解釈できるようにすることは、AI研究における今後のチャレンジの一つでしょうね。

そして、「AIによる意味理解」にフォーカスした場合、もう一つ重要な観点があります。それは「AIそのものは身体を持っていない」ということです。

——なぜ、AIが「身体を持っていないこと」が重要なのでしょうか?

谷口:「理解は『行動』によって示される」という考え方があります。

行動や実践の結果として生起した事象や、事物の実用性を重視するプラグマティズムという思想を提唱した、アメリカの哲学者であるチャールズ・サンダース・パースは「解釈」という概念をいくつかに分類しました。そのうちの一つが「活動的解釈項」です。これは、「ある主体による物事の解釈とは、その主体の行動によって示されるものである」という考え方で、ロボティクスの分野においてしばしば言及されます。

たとえば、高性能AIを搭載したサービスロボットに「机にお茶をこぼしてしまったから、紙ナプキンを取ってくれないか」とお願いするとしましょう。すると、ロボットは「わかりました。紙ナプキンを取ってきます」と言いました。このとき、ロボットは「紙ナプキンを取って来てほしい」というお願いを、言語的には“理解”しているように思われます。でも、ロボットがそれからまったく動かなかったとしたら、それはこちらのお願いの意味を正しく解釈し、「理解している」と言えるでしょうか。

——人間に置き換えても、たとえば部下に何かを依頼して、その部下が「承知しました」と言ったのに行動を起こさなかったら「承知してないじゃないか」と思ってしまいます。

谷口:「言葉の解釈や理解は、行動によって示される」とするパースの主張を踏まえれば、身体を持たないAIが「理解できる」ことはかなり限定されます。もちろん、現段階でもAIは「紙ナプキンを取って来てほしい」という言葉の意味を言語的には理解できるでしょうが、その理解を示すことができないわけです。

さらに言えば、人間の言語は人間にしかしゃべれないわけですが、その理由の一つは「人間の身体を持っているのは、人間だけだから」です。というのも、人間はその身体を介して世界に触れているわけなので、世界を表現するための言葉も、当然人間の身体的な特徴に規定されます。

たとえば、「赤」という言葉。人間の網膜には錐体と呼ばれる視細胞があり、この錐体細胞は3種類存在します。そのそれぞれが、赤と緑と青の光に反応して脳に信号を送ることで、僕たちは世界の色を認識しています。

一方で、イヌやネコなど、多くの哺乳類は赤色の光に反応する錐体細胞を持っていないとされている。私たちが見る世界と、イヌやネコが見る世界の「色」は違っているはずなんです。だから、仮にイヌやネコが人間の言葉をしゃべれるようになったとしても、「赤」を「赤」として教えるのは難しい。「リンゴの色だ」と言っても、おそらくイヌやネコの目から、リンゴは“赤く”見えないはずですからね。

そのように、私たちの言葉は私たちの身体によって規定されています。人間が人間の身体を通してつくってきた言葉を、人間の身体を持たない存在に学習させ、意思疎通を図る。AI研究が挑んでいるのは、そんな人類史上初のチャレンジなんです。

AIは、あらゆる動物の「逆方向」から進化している

——AIというソフトウェアだけではなく、その身体となるハードウェアも統合的に進化させていかなければ、人間に近い「意味の理解」を再現できないわけですね。

谷口:そこが非常に難しいところなんです。人工知能分野の進化に比べると、ロボティクスの進化は遅い。ハードウェアをつくって動かさないといけないし、それには莫大な手間とコストがかかりますからね。それに、そもそも今のAI研究やロボティクスを含む科学は、人間や動物とはまったく逆方向から「知能の進化」を実現しようとしている。僕はここにも難しさがあると思っています。

アメリカの機械工学者であるハンス・モラベックは、研究を通して「人間にとって複雑な思考がAIにとっては簡単である一方で、人間が無意識に行っている、幼児にとっても簡単な感覚的・運動的タスクが、AIにとっては非常に困難である」ことを発見しました。このことを「モラベックのパラドックス」と言います。モラベックがこのパラドックスを示したのは、1980年代ですが、今も状況は変わっていません。生成AI全盛の時代にあって、家事を手伝うロボットが登場していない理由はここにあります。

人間の知能は、高次認知機能と低次認知機能に分けて語られることがあります。前者は絵画や音楽の創作、囲碁やチェスなどの高度なプレイ、多言語の習得など、一言で言ってしまえば思考するような「遅い」知的処理をする際に発揮される機能です。後者は、反射的な感覚や運動のように「速い」知的処理を通して、シンプルなタスクを実行するときに発揮されるものですね。

僕たち人間も含め、進化的に考えると、動物は基本的に低次認知機能を発揮する段階を経て、高次認知機能を獲得しました。たとえば、まずは天敵から逃げるために「走る」能力を獲得し、高いところにある木の実を採るために「木を登る」能力を獲得し……と、段階を経て認知能力を向上させ、やがて言語を体系化し、それを用いてコミュニケーションを取るなど、高次認知機能を手に入れました。

AI研究やロボティクスを含む科学は、いま逆の方向から知能をつくろうとしているわけです。つまり、高次側から知能をつくろうとしている。先ほども言ったように、これまで「身体なき言語」は存在していなかったわけですが、それは知能も同様です。現在のAIとロボティクスを巡る状況は、「脆弱な身体に、超高次認知機能だけを持った脳を入れ込もうとしている」と言ってもいいでしょう。そこにこの分野の難しさがあると思っています。

「AIは賢くなったけど、人間は賢くなっていない」では意味がない

——さまざまな壁を乗り越え、AIが身体を持って人間とともに暮らすようになったとして、私たちの暮らしや社会にどのような影響があると思われますか?

谷口:正直に言えば、まだわかりません。ただ、そういった問いが「考えるに値する問いになった」ということ自体が、大きな進歩だと思っています。10年前にそんなことを考えていたら「そんなSF映画みたいなことを考えたってしょうがない」と言われていたと思いますから。

記号創発システムの中に参入し、僕たちと記号をやり取りしながら生活するAIロボットが登場すれば、僕たちがその存在からさまざまな影響を受けることは間違いありません。それがどのようなものになるか、そして世界をどのような方向に変えるべきかを考えることは、僕の宿題ですね。

さらに言えば、現在僕らは人間同士で言葉を中心とした記号をやり取りしているわけですが、そこにChatGPTなども含むAIエージェントが入ってきたとき、もしかすると僕たちのコミュニケーションそのものが大きく変わる可能性もあるわけですよね。その変化がどのようなものになるかがわからなければ不安だし、それらのエージェントをいかに制御すべきか検討するためにも、その影響については十分に議論し、研究していかなければならないと思っています。

同時に、ロボットと共生する未来がどのようなものになるかを考えることは、さまざまな示唆を与えてくれるはずです。たとえば、視覚や聴覚などに障害を持つ方とのコミュニケーション方法。異なる身体的特徴を持つ者同士は、どのような記号を、どのように交わすことによってスムーズな意思疎通を実現できるのか。AIロボットとの共生について考えることは、そんな問題に対するヒントを提供してくれるはずです。

——AIとの共生を考えることは、多様な人間との共生を考えることにもつながるのですね。

谷口:AI研究のおもしろさというのは工学的な側面だけではなく、人文・社会科学的な側面、すなわち「人間」や「社会」を探求できるところにあると思っています。

「便利にはなったけど、社会がよくなったとは言えない」「AIは発達したけど、人間のことはまるでわからないまま」ではダメなんですよ。AIを進化させながら、人間という存在も発達させていきたいと思っています。

取材・執筆:鷲尾諒太郎

編集:光松瞳

関連記事

生成AIは私たちの「つくる」をいかに変えるのか——AIを活用する小説家・葦沢かもめが考える、「創造」の未来

「ブレーキを踏んだが止まってくれない」自動運転の日常化で浮かび上がるAIと人間の協調の新課題

「人とAIの“模倣”は本質的に同じ」Rubyの父・まつもとゆきひろに聞く、技術の進化と“模倣”の関係

人気記事